人工智能计算鸿沟:科学家缺乏用于研究的强大芯片

全世界的学术界都在为人工智能研究的计算能力不足而苦苦挣扎。调查显示 GPU 的访问存在巨大差异。

人工智能计算鸿沟:科学家缺乏用于研究的强大芯片

许多大学科学家对他们在该领域的研究中可用的计算能力有限感到沮丧 人工智能 对全球数十家机构的学者进行的调查显示,人工智能是可用的。

结果 1 于 10 月 30 日发表在预印本服务器 arXiv 上,表明学术界缺乏接触最先进计算系统的机会。这可能会影响您的能力 大语言模型 (LLM) 开发和开展其他人工智能研究项目。

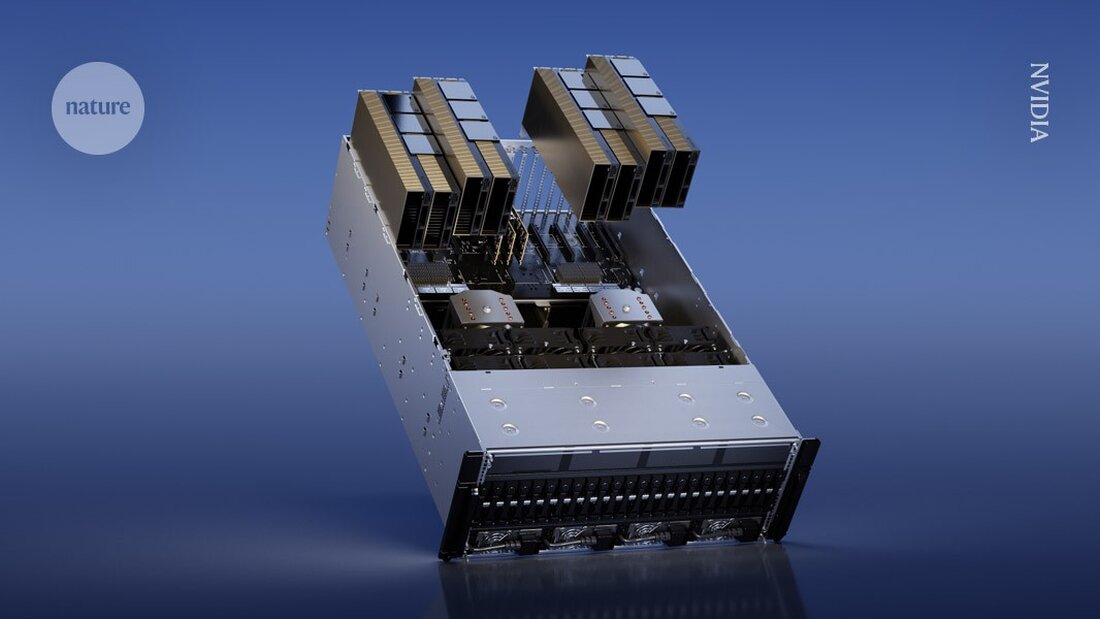

特别是学术研究人员有时没有强大的资源 图形处理器 (GPU) 购买——通常用于训练人工智能模型的计算机芯片,价格可能高达数千美元。相比之下,大型科技公司的研究人员预算更大,可以在 GPU 上投入更多。 “每个 GPU 都会增加更多的功能,”该研究的合著者、罗德岛州普罗维登斯布朗大学的计算机科学家 Apoorv Khandelwal 说道。 “虽然这些行业巨头可能拥有数千个 GPU,但学术界可能只有几个。”

“学术模型和工业模型之间的差距很大,但可能会小得多,”华盛顿特区非营利人工智能研究机构 EleutherAI 的执行董事斯特拉·比德曼 (Stella Biderman) 说。她补充道,对这种不平等的研究“非常重要”。

等待时间慢

为了评估学术界可用的计算资源,Khandelwal 和他的同事对来自 35 个机构的 50 名科学家进行了调查。在接受调查的人中,66% 的人对自己的计算能力的满意度为 3 分或更低(满分 5 分)。“他们根本不满意,”Khandelwal 说。

大学对于 GPU 的使用有不同的规定。有些可能有一个在院系和学生之间共享的中央计算集群,研究人员可以在其中请求 GPU 时间。其他机构可以购买可供实验室成员直接使用的机器。

一些科学家报告称,必须等待数天才能访问 GPU,并指出在项目截止日期前后等待时间特别长(请参阅“计算资源瓶颈”)。结果还凸显了全球获取机会的不平等。例如,一位受访者提到在中东寻找 GPU 很困难。只有 10% 的受访者表示他们可以访问 NVIDIA 的 H100 GPU ,拥有专为人工智能研究而设计的强大芯片。

这一障碍使得预训练过程——将大型数据集输入法学硕士——特别具有挑战性。 “费用如此之高,以至于大多数学者甚至不考虑在预训练中进行科学研究,”坎德尔瓦尔说。他和他的同事认为,学术界为人工智能研究提供了独特的视角,而缺乏计算能力可能会限制该研究领域。

“拥有一个健康、有竞争力的学术研究环境对于长期增长和长期技术发展非常重要,”在布朗大学研究计算机科学和语言学的合著者埃莉·帕夫利克 (Ellie Pavlick) 说。 “当你在工业界进行研究时,存在明显的商业压力,有时会诱使你更快地利用并更少地探索。”

高效的方法

研究人员还研究了学术界如何更好地利用功能较弱的计算资源。他们计算了使用低资源硬件(1 到 8 个 GPU)预训练多个 LLM 需要多少时间。尽管资源有限,研究人员还是成功地训练了许多模型,尽管花费了更长的时间并且要求他们使用更有效的方法。

“我们实际上可以更长时间地使用我们拥有的 GPU,因此我们可以消除行业之间的一些差异,”Khandelwal 说。

“令人兴奋的是,即使计算资源有限,您实际上也可以训练比许多人想象的更大的模型,”德国萨尔布吕肯萨尔州大学研究神经显式模型的 Ji-Ung Lee 说道。他补充说,未来的工作可以关注小公司工业研究人员的经验,这些研究人员也在获取计算资源方面遇到困难。 “并不是每个拥有无限计算能力的人都能真正获得它,”他说。

-

坎德尔瓦尔,A.等人。预印本位于 arXiv https://doi.org/10.48550/arXiv.2410.23261 (2024)。

Suche

Suche

Mein Konto

Mein Konto