Divario informatico nell’intelligenza artificiale: gli scienziati non hanno accesso a chip potenti per le loro ricerche

Gli accademici di tutto il mondo stanno lottando con una potenza di calcolo insufficiente per la ricerca sull’intelligenza artificiale. Il sondaggio mostra grandi differenze nell'accesso alle GPU.

Divario informatico nell’intelligenza artificiale: gli scienziati non hanno accesso a chip potenti per le loro ricerche

Molti scienziati universitari sono frustrati dalla limitata potenza di calcolo a loro disposizione per le loro ricerche nel campo dell'informatica intelligenza artificiale (AI) è disponibile, come mostra un sondaggio condotto tra accademici di dozzine di istituzioni in tutto il mondo.

I risultati 1, pubblicati il 30 ottobre sul server di prestampa arXiv, suggeriscono che gli accademici non hanno accesso ai sistemi informatici più avanzati. Ciò potrebbe influire sulla tua capacità di farlo modelli linguistici di grandi dimensioni (LLM) per sviluppare e realizzare altri progetti di ricerca sull’intelligenza artificiale.

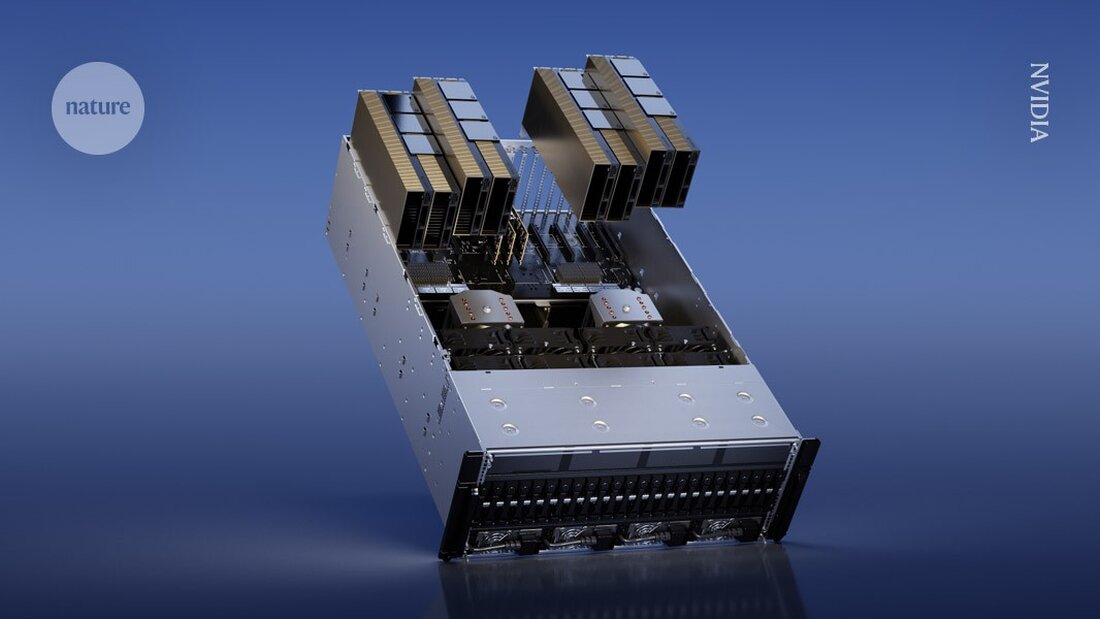

In particolare, i ricercatori accademici a volte non hanno le risorse per essere potenti Processori grafici (GPU) da acquistare: chip di computer comunemente utilizzati per addestrare modelli di intelligenza artificiale che possono costare diverse migliaia di dollari. Al contrario, i ricercatori delle grandi aziende tecnologiche hanno budget più ampi e possono spendere di più per le GPU. "Ogni GPU aggiunge più potenza", afferma il coautore dello studio Apoorv Khandelwal, informatico della Brown University di Providence, Rhode Island. “Mentre questi giganti del settore possono avere migliaia di GPU, gli accademici potrebbero averne solo poche”.

“Il divario tra i modelli accademici e industriali è ampio, ma potrebbe essere molto più ridotto”, afferma Stella Biderman, direttrice esecutiva di EleutherAI, un istituto di ricerca sull’intelligenza artificiale senza scopo di lucro a Washington DC. La ricerca su questa disuguaglianza è “molto importante”, aggiunge.

Tempi di attesa lenti

Per valutare le risorse informatiche a disposizione degli accademici, Khandelwal e i suoi colleghi hanno intervistato 50 scienziati provenienti da 35 istituzioni. Tra gli intervistati, il 66% ha valutato la propria soddisfazione nei confronti della propria potenza di calcolo come 3 o meno su una scala di 5. "Non sono affatto soddisfatti", afferma Khandelwal.

Le università hanno regolamenti diversi per l'accesso alle GPU. Alcuni potrebbero avere un cluster di elaborazione centrale condiviso tra dipartimenti e studenti in cui i ricercatori possono richiedere tempo GPU. Altre istituzioni potrebbero acquistare macchine che possono essere utilizzate direttamente dai membri del laboratorio.

Alcuni scienziati hanno riferito di aver dovuto attendere giorni per ottenere l’accesso alle GPU, sottolineando che i tempi di attesa erano particolarmente elevati in prossimità delle scadenze dei progetti (vedere “Collo di bottiglia delle risorse di calcolo”). I risultati evidenziano anche le disuguaglianze globali nell’accesso. Ad esempio, un intervistato ha menzionato la difficoltà di trovare GPU in Medio Oriente. Solo il 10% degli intervistati ha dichiarato di averne accesso Le GPU H100 di NVIDIA, per avere potenti chip progettati per la ricerca sull’intelligenza artificiale.

Questa barriera rende il processo di pre-formazione, ovvero l’inserimento di grandi set di dati nei LLM, particolarmente impegnativo. "È così costoso che la maggior parte degli accademici non prende nemmeno in considerazione l'idea di dedicarsi alla scienza durante la pre-formazione", afferma Khandelwal. Lui e i suoi colleghi ritengono che gli accademici offrano una prospettiva unica nella ricerca sull’intelligenza artificiale e che la mancanza di accesso alla potenza di calcolo potrebbe limitare il campo di ricerca.

"È davvero importante avere un ambiente di ricerca accademica sano e competitivo per la crescita e lo sviluppo tecnologico a lungo termine", afferma la coautrice Ellie Pavlick, che studia informatica e linguistica alla Brown University. “Quando si fa ricerca nell’industria, ci sono chiare pressioni commerciali che a volte inducono a sfruttare più velocemente ed esplorare meno”.

Metodi efficienti

I ricercatori hanno anche esaminato come gli accademici potrebbero utilizzare meglio le risorse informatiche meno potenti. Hanno calcolato quanto tempo sarebbe necessario per pre-addestrare più LLM utilizzando hardware con risorse limitate, tra 1 e 8 GPU. Nonostante queste risorse limitate, i ricercatori sono riusciti ad addestrare con successo molti modelli, anche se ci è voluto più tempo e hanno richiesto l’uso di metodi più efficienti.

"Possiamo effettivamente utilizzare le GPU di cui disponiamo più a lungo e quindi possiamo appianare alcune delle differenze tra ciò che offre il settore", afferma Khandelwal.

"È emozionante vedere che è possibile effettivamente addestrare un modello più grande di quanto molte persone immaginano, anche con risorse informatiche limitate", afferma Ji-Ung Lee, che studia modelli neuroespliciti alla Saarland University di Saarbrücken, in Germania. Aggiunge che il lavoro futuro potrebbe prendere in considerazione le esperienze dei ricercatori industriali presso le piccole aziende che hanno anch'esse difficoltà ad accedere alle risorse informatiche. "Non è che tutti coloro che hanno accesso a una potenza di calcolo illimitata la ottengano effettivamente", afferma.

-

Khandelwal, A. et al. Prestampa su arXiv https://doi.org/10.48550/arXiv.2410.23261 (2024).

Suche

Suche

Mein Konto

Mein Konto