AI által generált képek veszélyeztetett tudományt-így akarják a kutatók felismerni őket

A kutatók a tudományos kiadványokban harcolnak az AI által generált hamis képek ellen. Új kimutatási módszerek alakulnak ki.

AI által generált képek veszélyeztetett tudományt-így akarják a kutatók felismerni őket

A tudósok a számokat és a tömegtermelést hamis dokumentumokat manipulálják Kötelező kiadók - A problémás kéziratok már régóta kellemetlenek a tudományos irodalomban. A tudományos nyomozók fáradhatatlanul dolgoznak, hogy felfedje ezt a jogsértést és kijavítsa a tudományos nyilvántartást. De munkájuk egyre nehezebbé válik, mivel a csalók számára új, hatékony eszköz kialakult: generatív mesterséges intelligencia (AI).

"A generatív AI nagyon gyorsan fejlődik" - mondja Jana Christopher, Image integritási elemzője a FEBS Press -nál, Heidelberg, Németország. "A környéken dolgozó emberek - a képintegritás és a közzétételi politikák - egyre inkább aggódnak az általa bemutatott lehetőségek miatt."

A könnyedséggel Generatív AI eszközök szövegek, A képek és az adatok felvetik az egyre megbízhatatlan tudományos irodalom félelmét, amelyet hamis számokkal, kéziratokkal és következtetésekkel elárasztanak, amelyeket az emberek számára nehéz felismerni. Egy fegyververseny már kialakul, mivel az integritási szakemberek, a kiadók és a technológiai vállalatok szorgalmasan dolgoznak Fejlessze ki az AI eszközöket, amely segíthet gyorsan azonosítani a megtévesztő, AI által generált elemeket a speciális cikkekben.

"Ez egy ijesztő fejlemény" - mondja Christopher. "De vannak okos emberek és jó strukturális változások is javaslatot tesznek."

A kutatási integritási szakértők arról számolnak be, hogy bár az AI által generált szöveget számos folyóirat megengedi bizonyos körülmények között, az ilyen eszközök felhasználása a képek vagy más adatok létrehozásához kevésbé elfogadhatónak tekinthető. "A közeljövőben rendben lehetünk az AI által generált szöveggel"-mondja Elisabeth Bik, Kép -kriminalisztikai szakember és tanácsadó a kaliforniai San Francisco -ban. "De rajzolom a vonalat, amikor az adatok előállítása."

Bik, Christopher és mások azt sugallják, hogy az adatokat, beleértve a generatív AI -vel létrehozott képeket, az irodalomban már széles körben használják, és hogy a kötelező kiadók AI eszközöket használnak a kéziratok mennyiségének előállításához (lásd: „Kvíz: Tudsz észlelni az AI hamisításokat?”).

Az AI által gyártott képek azonosítása óriási kihívást jelent: gyakran szinte lehetetlen megkülönböztetni a valódi képeket szabad szemmel. "Úgy érezzük, hogy minden nap az AI által generált képekkel találkozunk"-mondja Christopher. "De ha nem tudja bebizonyítani, akkor nagyon kevés lehet, amit megtehetsz."

Van néhány egyértelmű példa a generatív AI használatára a tudományos képekben, például a most egy abszurd módon nagy nemi szerv hírhedt képe egy patkányról és értelmetlen címkék, amelyeket a MidJourney képeszközzel készítettek. A grafika, amelyet egy kereskedelmi magazin februárban tett közzé, viharot okozott a közösségi médiában, és volt néhány nappal később visszavonta -

A legtöbb eset azonban nem olyan nyilvánvaló. Az Adobe Photoshop vagy hasonló eszközök felhasználásával készített számadatok a generatív AI megjelenése előtt - különösen a molekuláris és a celluláris biológiában - gyakran feltűnő tulajdonságokat tartalmaznak, amelyeket a nyomozók felismerhetnek, például az azonos háttérrel vagy a csíkok vagy foltok szokatlan hiányában. Az AI által generált karakterek gyakran nem mutatnak ilyen tulajdonságokat. "Nagyon sok olyan papírt látok, amely arra készteti, hogy ezek a nyugati blotok nem tűnnek valósnak - de nincs dohányzó pisztoly" - mondja Bik. "Csak annyit mondhat, hogy csak furcsának tűnnek, és ez természetesen nem elég bizonyíték a szerkesztővel való kapcsolatfelvételhez."

Vannak azonban olyan jelek, hogy az AI által generált karakterek megjelennek a közzétett kéziratokban. Az olyan eszközökkel írt szövegek, mint a Chatgpt, a cikkekben növekszik, amelyeket a tipikus chatbot -mondatok mutatnak, amelyeket a szerzők elfelejtenek eltávolítani, és megkülönböztető szavakat, amelyeket az AI modellek általában használnak. "Tehát azt kell feltételeznünk, hogy ez az adatok és a képek esetében is megtörténik" - mondja Bik.

Egy másik jelzés arra, hogy a csalók kifinomult képalkotó eszközöket használnak, az, hogy a kutatók többsége a több éves művekben jelenik meg. "Az utóbbi években egyre kevesebb és kevesebb problémát láttunk a képekkel" - mondja Bik. "Úgy gondolom, hogy a képeket manipulált emberek többsége tisztább képeket készített."

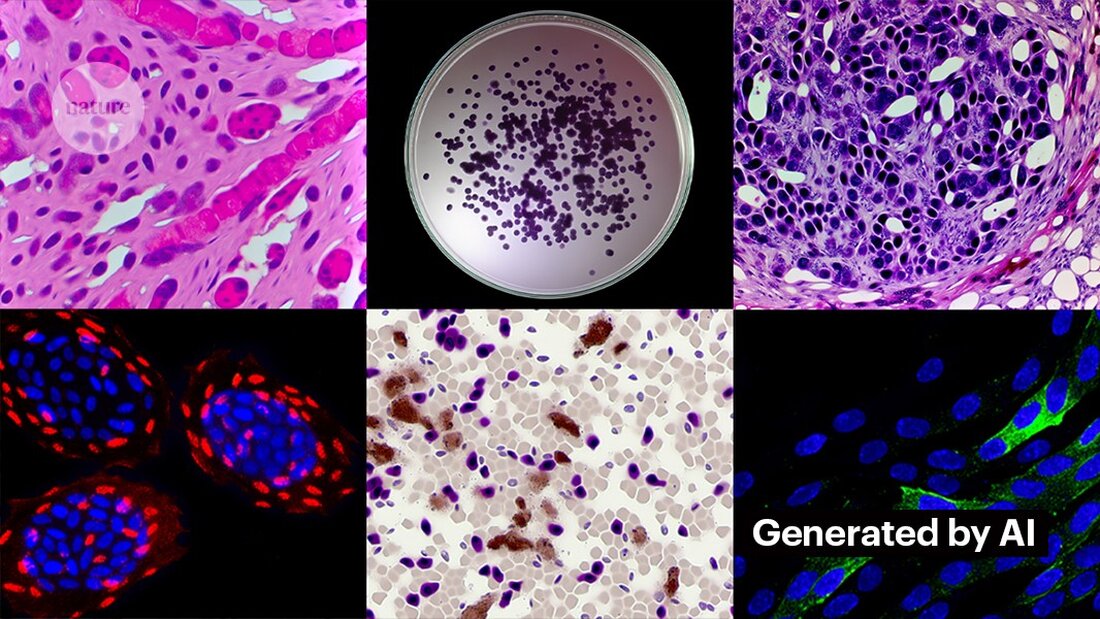

A tiszta képek létrehozása generatív AI -vel nem nehéz. Kevin Patrick, a Cheshire néven a közösségi médiában ismert tudományos imázs -nyomozó bebizonyította, mennyire könnyű lehet, és közzétette az X -en található eredményeit. A Photoshop AI eszköz generációs kitöltése segítségével Patrick reális képeket készített - amelyek a tudományos dokumentumokban megjelenhetnek - a daganatok, a sejttenyészetek, a nyugati blotok és még sok más. A legtöbb kép kevesebb, mint egy percet vett igénybe a létrehozáshoz (lásd: „Hamis tudomány generálása”).

"Ha meg tudom csinálni, akkor biztosan azok, akiknek fizetnek a hamis adatok létrehozásáért, akkor ezt is megteszik" - mondja Patrick. "Valószínűleg van egy csomó más adat, amelyet ilyen eszközökkel lehet létrehozni."

Egyes kiadók beszámolnak, hogy a közzétett tanulmányokban bizonyítékokat találnak az AI által generált tartalomról. Ez magában foglalja a PLOS-t, amelyet a gyanús tartalomra figyelmeztettek, és a belső vizsgálatok révén bizonyítékokat találtak az AI által generált szövegekről és adatokról-mondta Renée Hoch, a PLOS kiadványának etikai csapatának szerkesztője, a kaliforniai San Francisco-ban. (Hoch megjegyzi, hogy az AI használatát nem tiltják a PLOS folyóiratokban, és hogy az AI -politika a szerzői felelősségen és az átlátható nyilvánosságra hozatalon alapul.)

Más eszközök lehetőséget kínálhatnak azok számára is, akik hamis tartalmat akarnak létrehozni. A múlt hónapban a kutatók közzétették a 1 Generatív AI-modell nagy felbontású mikroszkóp képek létrehozására-és néhány integritási szakember aggodalmát fejezte ki ezzel a munkával kapcsolatban. "Ezt a technológiát könnyen használhatják a rossz szándékú emberek, hogy gyorsan több száz vagy több ezer hamis képet hozzanak létre" - mondja Bik.

Yoav Shechtman, a Technion-Izrael Technológiai Intézet, az eszköz alkotója, azt mondja, hogy az eszköz hasznos a modellek képzési adatainak létrehozásához, mivel a nagy felbontású mikroszkóp képeket nehéz beszerezni. De hozzáteszi, hogy ez nem hasznos a hamisítványok előállításához, mivel a felhasználók kevés ellenőrzést gyakorolnak az eredmények felett. A meglévő képszerkesztő szoftver, például a Photoshop hasznosabb az adatok manipulálásához - javasolja.

Bár az emberi szemek nem feltétlenül nem képesek Felismerje az AI által generált képeket, Az AI ezt megteheti (lásd: „Az AI képeket nehéz felismerni”).

Az olyan eszközök fejlesztői, mint az ImageTwin és a Proofig, amelyek AI -t használnak a tudományos képek integritási problémáinak észlelésére, kibővítik szoftverüket a generatív AI által létrehozott képek szűrésére. Mivel az ilyen képeket annyira nehéz felismerni, mindkét vállalat létrehozza a generatív AI képek saját adatbázisát az algoritmusok kiképzéséhez.

A Proofig már kiadott egy eszközt az AI által generált mikroszkóp képek felismerésére. Dror Kolodkin-Gal társalapítója, az izraeli Rehovotban, azt mondja, hogy a cikkekből származó több ezer AI által generált és valós kép tesztelésekor az algoritmus helyesen azonosította az AI képeket az idő 98% -ában, és hamis pozitív aránya 0,02% volt. Dror hozzáteszi, hogy a csapat most megpróbálja megérteni, hogy pontosan mit észlel az algoritmusuk.

"Nagyon reményeim vannak ezekre az eszközökre" - mondja Christopher. Megjegyzi azonban, hogy eredményeiket mindig olyan szakértőknek kell értékelniük, akik ellenőrizhetik az általuk jelzett problémákat. Christopher még nem látott bizonyítékot arra, hogy az AI képfelismerő szoftver megbízható (a Proyig belső értékelését még nem tették közzé). Ezek az eszközök „korlátozottak, de minden bizonnyal nagyon hasznosak, ha lehetővé teszik számunkra a benyújtási felülvizsgálati erőfeszítések méretezését” - tette hozzá.

Sok kiadó és kutatóintézet már használja azt Bizonyíték és Képalkotó - Például a tudományos folyóiratok a PREYIG -t használják a képek integritási problémáinak ellenőrzésére. Meagan Phelan, a washingtoni DC tudományos kommunikációs igazgatója szerint az eszköz még nem fedezte fel az AI által generált képet.

A Springer Nature, a Nature's Publisher fejleszti saját szöveg- és képérzékelő eszközeit, az úgynevezett Geppetto és Snapshot nevű szöveges és képérzékelő eszközeit, amelyek az emberek által azután értékelt szabálytalanságokat jelölik. (A Nature News Team szerkesztőségi szempontból független a kiadójától.)

A kiadói csoportok lépéseket tesznek az AI által generált képekre való válaszadáshoz. A tudományos, műszaki és orvosi (STM) Nemzetközi Szövetség (STM) Nemzetközi Szövetségének szóvivője Oxfordban, az Egyesült Királyságban azt mondta, hogy "nagyon komolyan" veszi a kérdést, és reagált az olyan kezdeményezésekre, mint például United2ACT és az STM Integrity Hub, amely a kötelező kiadásokkal és más tudományos integritási kérdésekkel kapcsolatos jelenlegi kérdésekkel foglalkozik.

Christopher, aki a képváltozások és a duplikációk STM munkacsoportját vezeti, azt mondja, hogy egyre növekszik a tudatosság, hogy a nyers adatok ellenőrzésének módjainak kidolgozására van szükség - például a használt mikroszkópokkal készített képek címkézésével, hasonlóan a használthoz hasonlóan Vízjelek AI által generált szövegekben - Ez lehet a helyes út. Ehhez új technológiákat és új szabványokat igényel az eszközgyártók számára - tette hozzá.

Patrick és mások attól tartanak, hogy a kiadók nem viselkednek elég gyorsan a fenyegetés kezelésére. "Attól tartunk, hogy ez csak az irodalomban a problémák újabb generációja lesz, amellyel nem foglalkoznak, amíg túl késő lesz" - mondja.

Ennek ellenére néhány optimista, hogy a mai cikkekben megjelenő AI által generált tartalmat a jövőben fedezik fel.

"Minden bizalommal bírom, hogy a technológia tovább javul, ahol felismeri a ma létrehozott adatokat - mert ezt egy bizonyos ponton viszonylag durvanak tekintik" - mondja Patrick. "A csalóknak nem szabad aludniuk éjszaka. Becsaphatják a jelenlegi folyamatot, de nem hiszem, hogy örökre becsaphatják a folyamatot."

-

Saguy, A. et al. Kicsi met. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto