الصور التي ينشئها الذكاء الاصطناعي تعرض العلم للخطر، وهذه هي الطريقة التي يريد الباحثون التعرف عليها

يكافح الباحثون ضد الصور المزيفة التي ينتجها الذكاء الاصطناعي في المنشورات العلمية. يتم تطوير طرق جديدة للكشف.

الصور التي ينشئها الذكاء الاصطناعي تعرض العلم للخطر، وهذه هي الطريقة التي يريد الباحثون التعرف عليها

العلماء يتلاعبون بالأرقام وينتجون أوراقًا مزورة بكميات كبيرة الناشرون الإلزاميون - المخطوطات الإشكالية كانت لفترة طويلة مصدر إزعاج في الأدبيات العلمية. المحققون العلميون يعملون بلا كلل لكشف هذا الخلل وتصحيح السجل العلمي. لكن مهمتهم أصبحت صعبة على نحو متزايد مع ظهور أداة قوية جديدة للمحتالين: أداة توليدية الذكاء الاصطناعي (منظمة العفو الدولية).

يقول: "إن الذكاء الاصطناعي التوليدي يتطور بسرعة كبيرة". جانا كريستوفر ، محلل سلامة الصور في مطبعة FEBS في هايدلبرغ، ألمانيا. "الأشخاص الذين يعملون في منطقتي - سلامة الصور وسياسات النشر - أصبحوا يشعرون بقلق متزايد بشأن الإمكانيات التي تقدمها".

السهولة التي نصوص أدوات الذكاء الاصطناعي التوليدية والصور والبيانات تثير المخاوف من الأدبيات العلمية التي لا يمكن الاعتماد عليها بشكل متزايد، والتي تغمرها الأرقام والمخطوطات والاستنتاجات المزيفة التي يصعب على البشر اكتشافها. لقد بدأ سباق التسلح في الظهور بالفعل حيث يعمل المتخصصون في النزاهة والناشرون وشركات التكنولوجيا بجد من أجل ذلك تطوير أدوات الذكاء الاصطناعي ، والتي يمكن أن تساعد في التعرف بسرعة على العناصر الخادعة التي أنشأها الذكاء الاصطناعي في المقالات المتخصصة.

يقول كريستوفر: "إنه تطور مخيف". "ولكن هناك أيضًا أشخاص أذكياء ويتم اقتراح تغييرات هيكلية جيدة."

أفاد خبراء نزاهة الأبحاث أنه على الرغم من أن النصوص التي تم إنشاؤها بواسطة الذكاء الاصطناعي مسموح بها بالفعل في ظل ظروف معينة من قبل العديد من المجلات، فإن استخدام مثل هذه الأدوات لإنشاء صور أو بيانات أخرى قد يعتبر أقل قبولا. يقول: "في المستقبل القريب، قد نوافق على استخدام النصوص التي ينشئها الذكاء الاصطناعي". إليزابيث بيك ، متخصص ومستشار في الطب الشرعي للصور في سان فرانسيسكو، كاليفورنيا. "لكنني أرسم الخط الفاصل عندما يتعلق الأمر بتوليد البيانات."

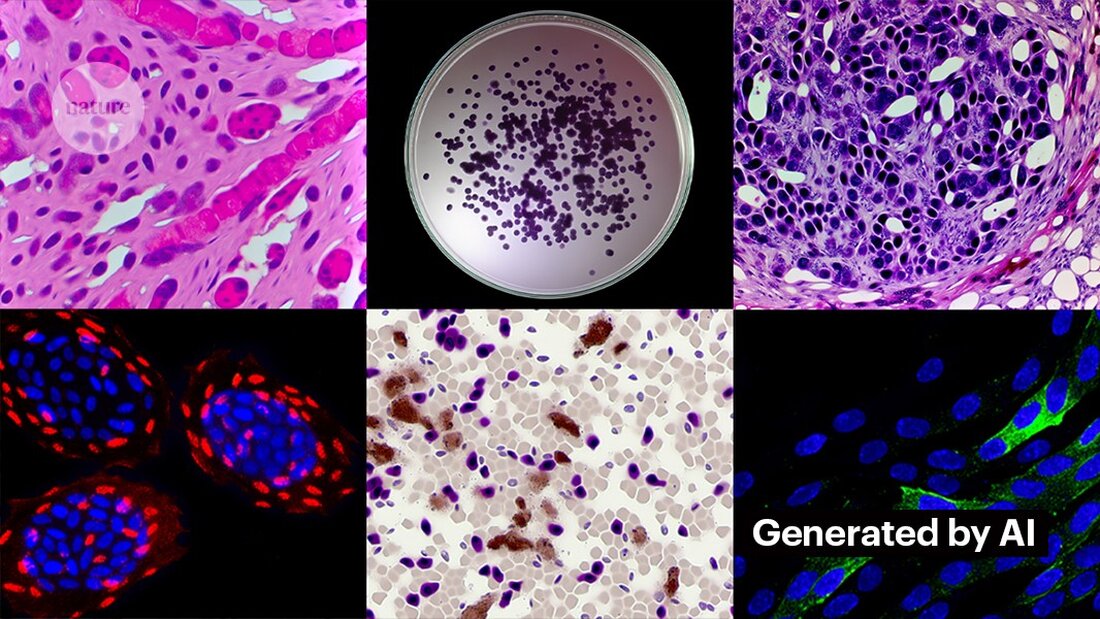

ويشير بيك، وكريستوفر، وآخرون إلى أن البيانات، بما في ذلك الصور، التي تم إنشاؤها باستخدام الذكاء الاصطناعي التوليدي، تُستخدم بالفعل على نطاق واسع في الأدب، وأن الناشرين الإلزاميين يستخدمون أدوات الذكاء الاصطناعي لإنتاج مخطوطات بكميات كبيرة (انظر: "اختبار: هل يمكنك اكتشاف تزوير الذكاء الاصطناعي؟").

يشكل تحديد الصور التي ينتجها الذكاء الاصطناعي تحدياً هائلاً: فغالباً ما يكون من المستحيل تقريباً تمييزها عن الصور الحقيقية بالعين المجردة. يقول كريستوفر: "نشعر وكأننا نشاهد صورًا تم إنشاؤها بواسطة الذكاء الاصطناعي كل يوم". "ولكن ما لم تتمكن من إثبات ذلك، فليس هناك الكثير مما يمكنك فعله."

هناك بعض الأمثلة الواضحة لاستخدام الذكاء الاصطناعي التوليدي في الصور العلمية، مثل الآن صورة سيئة السمعة لفأر بأعضاء تناسلية كبيرة بشكل سخيف والتسميات غير المنطقية، التي تم إنشاؤها باستخدام أداة الصور Midjourney. وأثار الرسم الذي نشرته إحدى المجلات التجارية في فبراير/شباط الماضي، عاصفة على مواقع التواصل الاجتماعي تم سحبها بعد بضعة أيام.

ومع ذلك، فإن معظم الحالات ليست واضحة جدا. غالبًا ما تحتوي الأشكال التي تم إنشاؤها باستخدام Adobe Photoshop أو أدوات مماثلة قبل ظهور الذكاء الاصطناعي التوليدي - خاصة في البيولوجيا الجزيئية والخلوية - على ميزات مذهلة يمكن للمحققين التعرف عليها، مثل الخلفيات المتطابقة أو النقص غير المعتاد في الخطوط أو البقع. غالبًا لا تظهر الشخصيات التي تم إنشاؤها بواسطة الذكاء الاصطناعي مثل هذه الخصائص. يقول بيك: "أرى الكثير من الأوراق البحثية التي تجعلني أعتقد أن هذه البقع الغربية لا تبدو حقيقية، لكن ليس هناك دليل دامغ". "كل ما يمكنك قوله هو أنها تبدو غريبة، وبالطبع هذا ليس دليلاً كافياً للاتصال بالمحرر."

ومع ذلك، هناك دلائل تشير إلى ظهور الأحرف التي تم إنشاؤها بواسطة الذكاء الاصطناعي في المخطوطات المنشورة. تتزايد أعداد النصوص المكتوبة باستخدام أدوات مثل ChatGPT في المقالات، وهو ما يتضح من خلال عبارات chatbot النموذجية التي ينسى المؤلفون إزالتها والكلمات المميزة التي تميل نماذج الذكاء الاصطناعي إلى استخدامها. يقول بيك: "لذلك علينا أن نفترض أن هذا يحدث أيضًا بالنسبة للبيانات والصور".

مؤشر آخر على أن المحتالين يستخدمون أدوات تصوير متطورة هو أن معظم المشكلات التي يجدها المحققون حاليًا تظهر في أعمال عمرها عدة سنوات. يقول بيك: "في السنوات الأخيرة، شهدنا مشاكل أقل وأقل فيما يتعلق بالصور". "أعتقد أن معظم الأشخاص الذين تم القبض عليهم وهم يتلاعبون بالصور بدأوا في إنشاء صور أكثر وضوحًا."

إن إنشاء صور نظيفة باستخدام الذكاء الاصطناعي التوليدي ليس بالأمر الصعب. أظهر كيفن باتريك، وهو محقق الصور العلمية المعروف باسم شيشاير على وسائل التواصل الاجتماعي، مدى سهولة الأمر ونشر النتائج التي توصل إليها على X. وباستخدام أداة Geneativefill للذكاء الاصطناعي في Photoshop، أنشأ باتريك صورًا واقعية - يمكن أن تظهر في الأوراق العلمية - للأورام ومزارع الخلايا والبقع الغربية والمزيد. استغرق إنشاء معظم الصور أقل من دقيقة (انظر: "إنشاء علوم زائفة").

يقول باتريك: "إذا كان بإمكاني فعل ذلك، فمن المؤكد أن أولئك الذين يحصلون على أموال مقابل إنشاء بيانات مزيفة سيفعلون ذلك أيضًا". "من المحتمل أن يكون هناك الكثير من البيانات الأخرى التي يمكن إنشاؤها باستخدام أدوات مثل هذه."

أبلغ بعض الناشرين عن العثور على أدلة على محتوى تم إنشاؤه بواسطة الذكاء الاصطناعي في الدراسات المنشورة. يتضمن ذلك PLoS، الذي تم تنبيهه إلى محتوى مشبوه ووجد أدلة على النصوص والبيانات التي تم إنشاؤها بواسطة الذكاء الاصطناعي في المقالات والمشاركات من خلال التحقيقات الداخلية، كما يقول رينيه هوش، محرر فريق أخلاقيات النشر في PLoS في سان فرانسيسكو، كاليفورنيا. (يشير هوش إلى أن استخدام الذكاء الاصطناعي ليس محظورًا في مجلات PLoS وأن سياسة الذكاء الاصطناعي تعتمد على مسؤولية المؤلف والإفصاحات الشفافة.)

يمكن أن توفر الأدوات الأخرى أيضًا فرصًا للأشخاص الذين يرغبون في إنشاء محتوى مزيف. نشر الباحثون الشهر الماضي أ 1 نموذج الذكاء الاصطناعي التوليدي لإنشاء صور مجهرية عالية الدقة - وقد أعرب بعض المتخصصين في النزاهة عن مخاوفهم بشأن هذا العمل. يقول بيك: "يمكن بسهولة استخدام هذه التكنولوجيا من قبل الأشخاص ذوي النوايا السيئة لإنشاء مئات أو آلاف الصور المزيفة بسرعة".

يقول يوآف شيختمان، من معهد التخنيون الإسرائيلي للتكنولوجيا في حيفا، وهو مبتكر الأداة، إن الأداة مفيدة في إنشاء بيانات تدريب للنماذج، نظرًا لصعوبة الحصول على صور مجهرية عالية الدقة. لكنه يضيف أنه ليس من المفيد إنتاج منتجات مزيفة لأن المستخدمين ليس لديهم سيطرة تذكر على النتائج. ويشير إلى أن برامج تحرير الصور الحالية، مثل Photoshop، أكثر فائدة في معالجة الأشكال.

على الرغم من أن عيون الإنسان قد لا تكون قادرة على ذلك التعرف على الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي ، من المحتمل أن يقوم الذكاء الاصطناعي بذلك (انظر "يصعب التعرف على صور الذكاء الاصطناعي").

يقوم مطورو أدوات مثل Imagetwin وProofig، التي تستخدم الذكاء الاصطناعي لاكتشاف مشكلات السلامة في الصور العلمية، بتوسيع برامجهم لتصفية الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي التوليدي. ونظرًا لصعوبة التعرف على مثل هذه الصور، تقوم كلا الشركتين بإنشاء قواعد بيانات خاصة بهما لصور الذكاء الاصطناعي التوليدية لتدريب خوارزمياتهما.

أصدرت Proofig بالفعل ميزة في أداتها للتعرف على الصور المجهرية التي تم إنشاؤها بواسطة الذكاء الاصطناعي. يقول المؤسس المشارك درور كولودكين غال في رحوفوت بإسرائيل، إنه في الاختبار باستخدام آلاف الصور الحقيقية والمولدة بواسطة الذكاء الاصطناعي من المقالات، حددت الخوارزمية بشكل صحيح صور الذكاء الاصطناعي بنسبة 98% من الوقت وحصلت على معدل إيجابي كاذب بنسبة 0.02%. ويضيف درور أن الفريق يحاول الآن فهم ما تكتشفه الخوارزمية بالضبط.

يقول كريستوفر: "لدي آمال كبيرة في هذه الأدوات". ومع ذلك، فإنها تشير إلى أن نتائجها يجب أن يتم تقييمها دائمًا من قبل خبراء يمكنهم التحقق من المشكلات التي تشير إليها. لم ير كريستوفر حتى الآن أي دليل على موثوقية برنامج التعرف على الصور بالذكاء الاصطناعي (لم يتم نشر تقييم Proofig الداخلي بعد). وتضيف قائلة إن هذه الأدوات "محدودة، ولكنها بالتأكيد مفيدة جدًا في السماح لنا بتوسيع نطاق جهود مراجعة الطلبات المقدمة لدينا".

العديد من الناشرين والمؤسسات البحثية يستخدمونه بالفعل دليل و إيماجتوين. على سبيل المثال، تستخدم المجلات العلمية Proofig للتحقق من مشكلات السلامة في الصور. ووفقاً لميغان فيلان، مدير الاتصالات للعلوم في واشنطن العاصمة، فإن الأداة لم تكتشف بعد أي صور تم إنشاؤها بواسطة الذكاء الاصطناعي.

تعمل شركة Springer Nature، وهي دار نشر Nature، على تطوير أدواتها الخاصة للكشف عن النصوص والصور، والتي تسمى Geppetto وSnapShot، والتي تحدد المخالفات التي يتم تقييمها بعد ذلك من قبل البشر. (فريق أخبار Nature مستقل تحريريًا عن ناشره).

تتخذ مجموعات النشر أيضًا خطوات للرد على الصور التي ينشئها الذكاء الاصطناعي. وقال متحدث باسم الرابطة الدولية للناشرين العلميين والتقنيين والطبيين (STM) في أكسفورد بالمملكة المتحدة، إنها تأخذ هذه القضية "على محمل الجد" وتستجيب لمبادرات مثل United2Act وSTM Integrity Hub، الذي يعالج المشكلات الحالية المتعلقة بالنشر الإلزامي وقضايا النزاهة الأكاديمية الأخرى.

يقول كريستوفر، الذي يقود مجموعة عمل STM بشأن تعديلات الصور وتكرارها، إن هناك وعيًا متزايدًا بأنه سيكون من الضروري تطوير طرق للتحقق من البيانات الأولية - على سبيل المثال، عن طريق وضع علامات مائية غير مرئية على الصور الملتقطة بالمجاهر مماثلة لتلك المستخدمة. العلامات المائية في النصوص التي تم إنشاؤها بواسطة الذكاء الاصطناعي - يمكن أن يكون هذا هو الطريق الصحيح. وتضيف أن هذا يتطلب تقنيات جديدة ومعايير جديدة لمصنعي الأجهزة.

يشعر باتريك وآخرون بالقلق من أن الناشرين لا يتصرفون بالسرعة الكافية لمواجهة التهديد. ويقول: "نخشى أن يكون هذا مجرد جيل آخر من المشكلات في الأدبيات التي لا يعالجونها إلا بعد فوات الأوان".

ومع ذلك، فإن البعض متفائل بأن المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي والذي يظهر في المقالات اليوم سيتم اكتشافه في المستقبل.

يقول باتريك: "لدي ثقة تامة في أن التكنولوجيا سوف تتحسن إلى النقطة التي تتعرف فيها على البيانات التي يتم إنشاؤها اليوم - لأنه في مرحلة ما سيعتبر هذا فظًا نسبيًا". "لا ينبغي للمحتالين أن يناموا جيداً في الليل. يمكنهم خداع العملية الحالية، لكنني لا أعتقد أنهم يستطيعون خداع العملية إلى الأبد."

-

ساغي، A. وآخرون. ميث صغير. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto