Tutkijat käyttävät tähtitieteen tekniikoita tietokoneen luomiseksi "Deepfake" -kuvat Tunnistaminen - mikä ensi silmäyksellä voi näyttää samanlaiselta todellisiin valokuviin.

Analysoimalla etägalaksien tutkimiseen tyypillisesti käytettyjä kasvoja tähtitieteilijät voivat mitata, kuinka ihmisen silmät heijastavat valoa, mikä voi osoittaa kuvan manipuloinnin merkkejä.

"Se ei ole ihmelääke, koska meillä on vääriä positiivisia ja vääriä negatiivisia", kertoo Kevin Pimbblet, tietotekniikan, tekoälyn ja mallinnuksen keskuksen johtaja Hullin yliopistossa, Iso -Britanniassa. Hän esitteli tutkimuksen Royal Astronomical Society: n kansallisessa tähtitieteen kokouksessa 15. heinäkuuta. "Mutta tämä tutkimus tarjoaa potentiaalisen menetelmän, tärkeän askeleen eteenpäin, mahdollisesti lisätä testejä, joita voidaan käyttää selvittämään, onko kuva todellinen vai väärennös."

Ilmaistu valokuvia

Keinotekoisen älykkyyden edistysaskeleet tekevät yhä vaikeampaa kertoa erojen todellisten kuvien, videoiden ja äänen välillä Algoritmien luomat, tunnistaa. Deepfakes korvaa yhden ihmisen tai ympäristön ominaisuudet muilla ja voi saada sen näyttämään siltä, että ihmiset olisivat sanoneet tai tehneet asioita, joita he eivät tehneet. Viranomaiset varoittavat, että tämä tekniikka on militarisoi ja myötävaikuttaa väärän tiedon leviämiseen, esimerkiksi vaaleissa, voidaan käyttää.

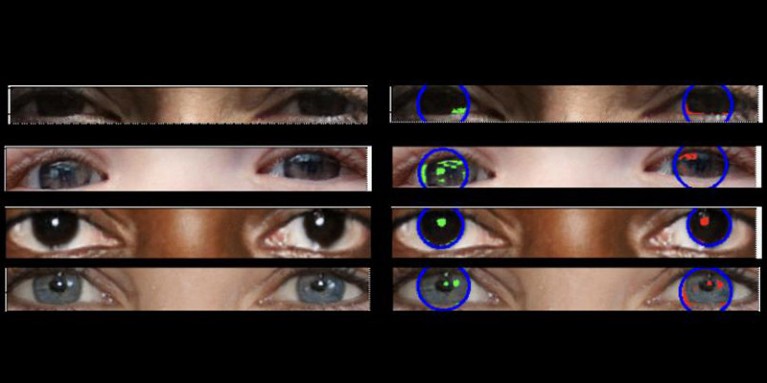

Oikeissa valokuvissa tulisi olla "johdonmukainen fysiikka", Pimbblet selittää ", joten vasemman silmämunan heijastumien tulisi olla hyvin samankaltaisia, vaikkakaan ei välttämättä identtisiä, oikean silmämunan heijastuksiin". Erot ovat hienovaraisia, joten tutkijat kääntyivät tekniikoihin, jotka on kehitetty valon analysoimiseksi tähtitieteellisissä kuvissa.

Teos, jota ei ole vielä julkaistu Owolabi, Iso -Britannian Hull -yliopiston tietotekniikka, hankki todellisia kuvia Flickr faces HQ -aineisto ja loi vääriä kasvoja kuvan generaattorin avulla. Sitten Owolabi analysoi kuvien silmien valonlähteiden heijastuksia kahdella tähtitieteellisellä mittauksella: CAS -järjestelmä ja Gini -indeksi. CAS -järjestelmä kvantifioi objektin valon jakautumisen pitoisuuden, epäsymmetrian ja sileyden. Tämä tekniikka on antanut tähtitieteilijöille, mukaan lukien Pimbblet, karakterisoida ekstragalaktisten tähtien valoa vuosikymmenien ajan. GINI -indeksi mittaa valon jakautumisen epätasa -arvoa galaksien kuvissa.

Vertaamalla ihmisen silmämunan heijastuksia Owolabi pystyi ennustamaan oikein, onko kuva väärennös noin 70% ajasta. Viime kädessä tutkijat havaitsivat, että Gini -indeksi oli parempi kuin CAS -järjestelmä ennustamaan, onko kuvaa manipuloitu.

Santa Cruzin Kalifornian yliopiston astrofysiikka Brant Robertson suhtautuu tutkimukseen tervetulleeksi. "Jos pystyt kuitenkin laskemaan arvon, joka kvantifioi kuinka realistinen syvän fake -kuva voi ilmestyä, voit myös kouluttaa AI -mallin tuottamaan vielä parempia syviäfakkeja optimoimalla arvo", hän varoittaa.

Southamptonin yliopiston AI -tutkija Zhiwu Huang sanoo, että hänen omassa tutkimuksessaan ei ole tunnistettu epäjohdonmukaisia valokuvioita syvänkuvien silmissä. Mutta "vaikka spesifinen tekniikka silmämunan epäjohdonmukaisten heijastusten käytöstä ei välttämättä ole laajalti sovellettavissa, tällaiset tekniikat voisivat olla hyödyllisiä valaistuksen, varjojen ja heijastumien hienovaraisten poikkeavuuksien analysoinnissa kuvan eri osissa", hän sanoo. "Valon fysikaalisten ominaisuuksien epäjohdonmukaisuuksien havaitseminen voisi täydentää olemassa olevia menetelmiä ja parantaa syvän tyydyttämisen yleistä tarkkuutta."

Suche

Suche

Mein Konto

Mein Konto