Forskere bruger teknikker fra astronomi til at skabe computergenereret “Deepfake” -billeder At genkende - som ved første øjekast kan se identisk ud med rigtige fotos.

Ved at analysere billeder af ansigter, der typisk bruges til at studere fjerne galakser, kan astronomer måle, hvordan en persons øjne afspejler lys, hvilket kan indikere tegn på billedmanipulation.

”Det er ikke et universalmiddel, da vi har falske positive og falske negativer,” siger Kevin Pimbblet, direktør for Center for Data Science, Artificial Intelligence and Modeling på University of Hull, UK. Han præsenterede forskningen på Royal Astronomical Society's National Astronomy -møde den 15. juli. "Men denne forskning tilbyder en potentiel metode, et vigtigt skridt fremad, for potentielt at tilføje de test, der kan bruges til at finde ud af, om et billede er reelt eller falskt."

Udtrykte fotos

Fremskridt inden for kunstig intelligens (AI) gør det stadig vanskeligere at fortælle forskellen mellem ægte billeder, videoer og lyd dem oprettet af algoritmer, at genkende. Deepfakes erstatter funktioner i en person eller miljø med andre og kan få det til at se ud som om enkeltpersoner har sagt eller gjort ting, som de ikke gjorde. Myndighederne advarer om, at denne teknologi er militariserende og bidrager til spredning af forkert information, for eksempel under valg, kan bruges.

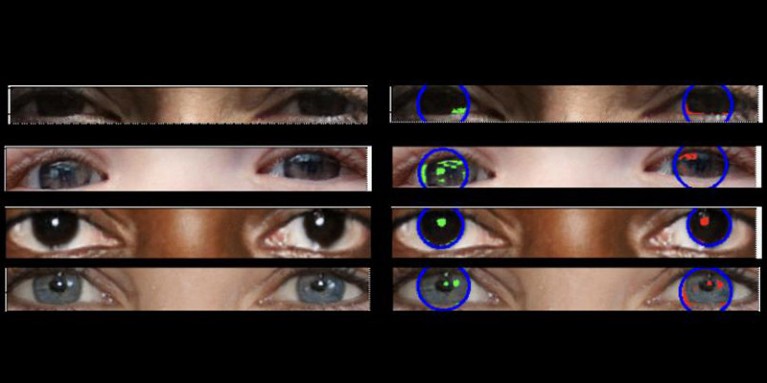

Ægte fotos skal have "konsekvent fysik", forklarer Pimbblet, "så de refleksioner, du ser i venstre øjeæble, skal være meget ens, skønt ikke nødvendigvis identiske, til refleksioner i højre øjeæble." Forskellene er subtile, så forskerne vendte sig mod teknikker, der er udviklet til analyse af lys på astronomiske billeder.

Arbejdet, der endnu ikke er blevet offentliggjort, dannede grundlaget for Adejumoke Owolabis mesters afhandling. Owolabi, en dataforsker ved University of Hull, UK, fremskaffede rigtige billeder fra Flickr står over for HQ -datasættet og skabte falske ansigter ved hjælp af en billedgenerator. Owolabi analyserede derefter refleksioner fra lyskilder i øjnene på billederne ved hjælp af to astronomiske målinger: CAS -systemet og Gini -indekset. CAS -systemet kvantificerer koncentrationen, asymmetrien og glatheden af et objekts lysfordeling. Denne teknik har gjort det muligt for astronomer, herunder Pimbblet, at karakterisere lyset af ekstragalaktiske stjerner i årtier. Gini -indekset måler uligheden af lysfordeling i billeder af galakser.

Ved at sammenligne refleksioner i en persons øjenkugler var Owolabi i stand til korrekt at forudsige, om billedet var falsk omkring 70% af tiden. I sidste ende fandt forskerne, at Gini -indekset var bedre end CAS -systemet til at forudsige, om et billede var blevet manipuleret.

Brant Robertson, en astrofysiker ved University of California, Santa Cruz, byder forskningen velkommen. ”Hvis du imidlertid kan beregne en værdi, der kvantificerer, hvor realistisk et DeepFake -billede kan vises, kan du også træne AI -modellen til at producere endnu bedre dybfakes ved at optimere denne værdi,” advarer han.

Zhiwu Huang, en AI -forsker ved University of Southampton, UK, siger, at hans egen forskning ikke har identificeret nogen inkonsekvente lysmønstre i øjnene på Deepfake -billeder. Men "mens den specifikke teknik til at bruge inkonsekvente refleksioner i øjenkuglerne muligvis ikke er vidt anvendelige, kan sådanne teknikker være nyttige til at analysere subtile afvigelser i belysning, skygger og refleksioner i forskellige dele af et billede," siger han. "Detektering af uoverensstemmelser i lysets fysiske egenskaber kan supplere eksisterende metoder og forbedre den samlede nøjagtighed af dybfake -detektion."

Suche

Suche

Mein Konto

Mein Konto