Vědci používají techniky z astronomie k vytvoření počítačového generovaného Obrázky „Deepfake“ Rozpoznat - což na první pohled může vypadat stejně jako skutečné fotografie.

Analýzou obrázků tváří, které se obvykle používají ke studiu vzdálených galaxií, mohou astronomové měřit, jak oči člověka odrážejí světlo, což může naznačovat známky manipulace s obrazem.

"Nejedná se o všelék, protože máme falešné pozitivy a falešné negativy," říká Kevin Pimbblelet, ředitel Centra pro vědu o datech, umělé inteligenci a modelování na University of Hull ve Velké Británii. Představil výzkum na národním setkání astronomie Royal Astronomical Society 15. července. „Tento výzkum však nabízí potenciální metodu, důležitý krok vpřed, aby potenciálně přidal testy, které lze použít k zjištění, zda je obraz skutečný nebo falešný.“

Vyjádřené fotografie

Pokroky v umělé inteligenci (AI) ztěžují rozlišování mezi skutečnými obrázky, videi a zvukem Ty vytvořené algoritmy, rozpoznat. Deepfakes nahrazují rysy jedné osoby nebo prostředí ostatními a mohou to vypadat, jako by jednotlivci řekli nebo dělali věci, které ne. Úřady varují, že tato technologie je militarizuje a přispívá k šíření dezinformací, Například během voleb, lze použít.

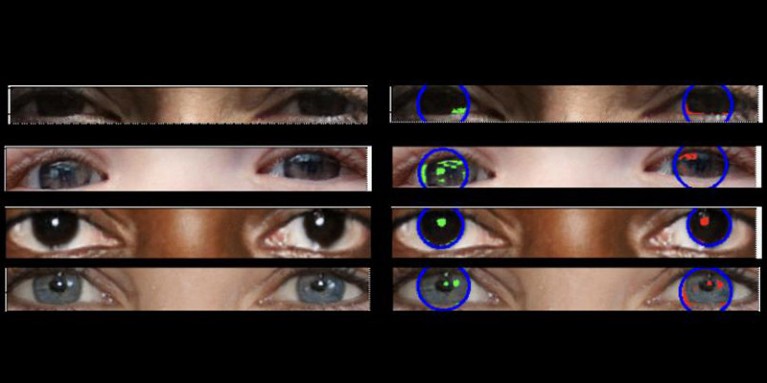

Skutečné fotografie by měly mít „konzistentní fyziku“, vysvětluje Pimbblet, „proto by odrazy, které vidíte v levém oční bulvách, měly být velmi podobné, i když ne nutně totožné, s odrazy v pravém oční bulvy.“ Rozdíly jsou jemné, takže vědci se obrátili na techniky vyvinuté pro analýzu světla v astronomických obrazech.

Práce, která dosud nebyla zveřejněna, tvořila základ pro diplomovou práci Adejumoke Owolabiho. Owolabi, vědec údajů z University of Hull ve Velké Británii, získal skutečné obrázky z Flickr čelí datové sadě HQ a vytvořily falešné tváře pomocí generátoru obrázků. Owolabi pak analyzoval odrazy ze světelných zdrojů v očích na obrázcích pomocí dvou astronomických měření: CAS systém a index Gini. Systém CAS kvantifikuje koncentraci, asymetrii a hladkost distribuce světla objektu. Tato technika umožnila astronomům, včetně Pimbblet, charakterizovat světlo extragalaktických hvězd po celá desetiletí. Index Gini měří nerovnost rozložení světla v obrázcích galaxií.

Porovnáním odrazů v očních bulvách osoby byl Owolabi schopen správně předpovídat, zda byl obraz falešný asi 70% času. Vědci nakonec zjistili, že index Gini byl lepší než systém CAS při předpovídání, zda byl obraz manipulován.

Brant Robertson, astrofyzik na Kalifornské univerzitě v Santa Cruz, vítá výzkum. "Pokud však dokážete vypočítat hodnotu, která kvantifikuje, jak realistický se může objevit hluboký obraz, můžete také trénovat model AI tak, aby vytvořili ještě lepší hlubokéfake optimalizací této hodnoty," varuje.

Zhiwu Huang, výzkumný pracovník AI na University of Southampton ve Velké Británii, říká, že jeho vlastní výzkum neidentifikoval žádné nekonzistentní světelné vzorce v očích hlubokých obrazů. Ale „zatímco specifická technika použití nekonzistentních odrazů v očních bulvách nemusí být široce použitelná, takové techniky by mohly být užitečné pro analýzu jemných anomálií při osvětlení, stínech a odrazy v různých částech obrazu,“ říká. "Detekce nesrovnalostí ve fyzikálních vlastnostech světla by mohla doplňovat stávající metody a zlepšit celkovou přesnost detekce hlubokého podoby."

Suche

Suche

Mein Konto

Mein Konto