Ai-ustvarjene slike ogrožajo znanost-tako jih želijo prepoznati raziskovalci

Raziskovalci se v znanstvenih publikacijah borijo proti AI-generiranim ponarejenim podobam. Razvijajo se nove metode odkrivanja.

Ai-ustvarjene slike ogrožajo znanost-tako jih želijo prepoznati raziskovalci

Znanstveniki, ki manipulirajo s številkami in množično proizvajajo ponarejene papirje Obvezni založniki - Problematični rokopisi so že dolgo v znanstveni literaturi nadloga. Znanstveni detektivi delujejo neumorno, da izpostavi to kršitev in popravi znanstveni zapis. Toda njihovo delo postaja vse težje, saj se je pojavilo novo, močno orodje za goljufije: generativno umetna inteligenca (Ai).

"Generativni AI se razvija zelo hitro," pravi Jana Christopher, Analitik za integriteto slike pri Febs Pressu v Heidelbergu v Nemčiji. "Ljudje, ki delajo na mojem območju - celovitost slike in politike objavljanja - postajajo vse bolj zaskrbljeni zaradi možnosti, ki jih predstavlja."

Enostavnost, s katero Besedila za generativne orodja AI, slike in podatki sprožajo strahove pred vse bolj nezanesljivim znanstvenim literaturo, preplavljene s ponarejenimi številkami, rokopisi in sklepi, ki jih je ljudem težko zaznati. Dirka z orožjem se že pojavlja kot strokovnjaki za integriteto, založniki in tehnološka podjetja, ki pridno delajo Razvijte orodja AI, kar lahko pomaga hitro prepoznati varljive, AI-generirane elemente v specializiranih člankih.

"To je zastrašujoč razvoj," pravi Christopher. "Vendar obstajajo tudi pametni ljudje in predlagane dobre strukturne spremembe."

Strokovnjaki za integriteto raziskav poročajo, da čeprav je besedilo, ki ga ustvari AI, v določenih okoliščinah v določenih okoliščinah že dovoljeno s strani takšnih orodij za ustvarjanje slik ali drugih podatkov, se lahko šteje za manj sprejemljive. "V bližnji prihodnosti smo morda v redu z besedilom, ki ga ustvari AI," pravi Elisabeth Bik, Strokovnjak za forenziko in svetovalec v San Franciscu v Kaliforniji. "Toda črto narišem, ko gre za ustvarjanje podatkov."

Bik, Christopher in drugi predlagajo, da se podatki, vključno s slikami, ustvarjeni z generativnim AI, že pogosto uporabljajo v literaturi in da obvezni založniki uporabljajo orodja AI za izdelavo rokopisov v količini (glejte "Kviz: Ali lahko opazite AI ponarejene?").

Prepoznavanje AI-proizvedenih slik predstavlja ogromen izziv: pogosto jih je skoraj nemogoče razlikovati od resničnih slik s prostim očesom. "Počutimo se, kot da vsak dan naletimo na slike, ustvarjene z AI," pravi Christopher. "Toda če tega ne morete dokazati, lahko resnično malo."

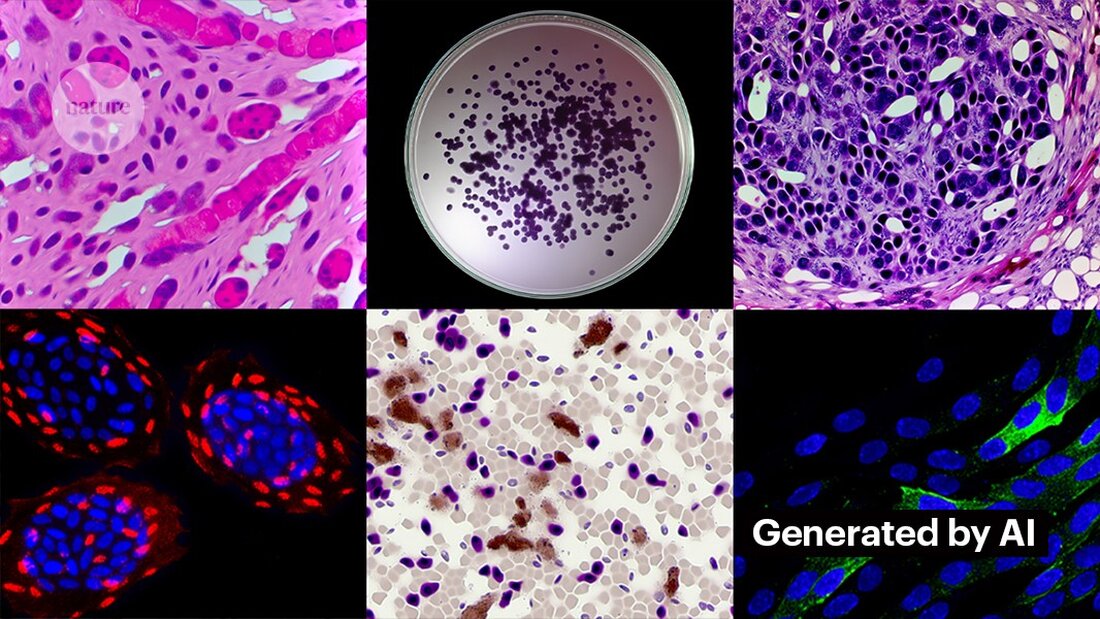

Obstaja nekaj jasnih primerov uporabe generativnega AI v znanstvenih slikah, kot je zdaj zloglasna podoba podgana z absurdno velikimi genitaliji in nesmiselne nalepke, ustvarjene z orodjem Midjourney Image. Grafika, ki jo je februarja objavila revija trgovine, je povzročila nevihto na družbenih medijih in je bila nekaj dni kasneje umaknjen.

Vendar večina primerov ni tako očitna. Številke, ustvarjene z uporabo Adobe Photoshop ali podobnih orodij pred pojavom generativne AI - zlasti v molekularni in celični biologiji - pogosto vsebujejo presenetljive lastnosti, ki jih lahko prepoznajo detektivi, kot so enaka ozadja ali nenavadno pomanjkanje proge ali pik. AI-generirani liki pogosto ne kažejo takšnih značilnosti. "Vidim veliko prispevkov, zaradi katerih mislim, da ti Western bloti ne izgledajo resnično - vendar ni pištole za kajenje," pravi Bik. "Vse, kar lahko rečete, je, da so videti samo čudno, in seveda to ni dovolj dokazov, da bi se obrnili na urednika."

Vendar pa obstajajo znaki, da se v objavljenih rokopisih pojavljajo znaki, ki jih ustvarijo AI. Besedila, napisana z orodji, kot je Chatgpt, se povečujejo v člankih, kar je razvidno iz tipičnih bratov chatbot, ki jih avtorji pozabijo odstraniti in značilne besede, ki jih AI modeli ponavadi uporabljajo. "Torej moramo domnevati, da se to zgodi tudi za podatke in slike," pravi Bik.

Drugi pokazatelj, da goljufi uporabljajo prefinjena orodja za slikanje, je, da večina težav preiskovalci trenutno najdejo v delih, starih nekaj let. "V zadnjih letih smo videli manj in manj težav s slikami," pravi Bik. "Mislim, da je večina ljudi, ki so jih ujeli manipuliranje slik, začela ustvarjati čistejše slike."

Ustvarjanje čistih slik z generativnim AI ni težko. Kevin Patrick, znanstveni detektiv slik, znan kot Cheshire na družbenih medijih, je pokazal, kako enostavno je in objavil svoje ugotovitve na X. S pomočjo Photoshop -ovega orodja AI Generative Fill je Patrick ustvaril realistične slike - ki bi se lahko pojavile v znanstvenih dokumentih - tumorjev, tumorjev, celičnih kultur, zahodnih blotov in še več. Večina slik je trajala manj kot minuto (glejte "Ustvarjanje lažne znanosti").

"Če lahko to storim, bodo zagotovo tudi tisti, ki so plačani za ustvarjanje ponarejenih podatkov," pravi Patrick. "Verjetno je še veliko drugih podatkov, ki bi jih bilo mogoče ustvariti z uporabo takšnih orodij."

Nekateri založniki poročajo, da so v objavljenih študijah ugotovili dokaze o vsebini, ki jih ustvarja AI. To vključuje PLOS, ki je bil opozorjen na sumljive vsebine in je našel dokaze o besedilu in podatkih, ki jih ustvarja AI, v člankih in prispevkih z notranjimi preiskavami, pravi Renée Hoch, urednica PLOS-ove publikacijske etične ekipe v San Franciscu v Kaliforniji. (Hoch ugotavlja, da uporaba AI v revijah PLoS ni prepovedana in da politika AI temelji na avtorski odgovornosti in preglednih razkritjih.)

Druga orodja bi lahko nudila tudi priložnosti za ljudi, ki želijo ustvariti ponarejeno vsebino. Prejšnji mesec so raziskovalci objavili a 1 Generativni AI model za ustvarjanje slik z mikroskopom z visoko ločljivostjo-nekateri strokovnjaki za integriteto so izrazili zaskrbljenost glede tega dela. "To tehnologijo lahko preprosto uporabijo ljudje s slabimi nameni za hitro ustvarjanje sto ali tisoč ponarejenih slik," pravi Bik.

Yoav Shechtman z Inštituta za tehnologijo Technion-Izrael v Haifi, ustvarjalec orodja, pravi, da je orodje koristno za ustvarjanje podatkov o vadbi za modele, ker je mikroskop z visoko ločljivostjo težko pridobiti. Vendar dodaja, da ni koristno za ustvarjanje ponaredkov, ker imajo uporabniki malo nadzora nad rezultati. Obstoječa programska oprema za urejanje slik, kot je Photoshop, je bolj uporabna za manipulacijo s številkami, predlaga.

Čeprav človeške oči morda ne bodo mogle Prepoznajte A-generirane slike, AI bi to lahko storil (glej "AI slike je težko prepoznati").

Razvijalci orodij, kot sta ImageTwin in Proofig, ki uporabljajo AI za odkrivanje problemov integritete v znanstvenih slikah, širijo svojo programsko opremo za filtriranje slik, ki jih ustvari generativni AI. Ker je takšne slike tako težko prepoznati, obe podjetji ustvarjata lastne baze podatkov o generativnih AI slik, da trenirajo svoje algoritme.

Profig je v svojem orodju že izdal funkcijo za prepoznavanje AI-ustvarjenih slik mikroskopa. Soustanovitelj Dror Kolodkin-Gal v Rehovotu v Izraelu pravi, da je pri testiranju s tisočimi AI-ustvarjenimi in resničnimi slikami iz člankov algoritem pravilno opredelil AI slike 98% časa in je imel lažno pozitivno stopnjo 0,02%. Dror dodaja, da ekipa zdaj poskuša razumeti, kaj natančno zazna njihov algoritem.

"Veliko upam na ta orodja," pravi Christopher. Vendar ugotavlja, da morajo njihove rezultate vedno oceniti strokovnjaki, ki lahko preverijo težave, ki jih označujejo. Christopher še ni videl dokazov, da je programska oprema za prepoznavanje slike AI zanesljiva (Notranja ocena Proofig še ni bila objavljena). Ta orodja so "omejena, a vsekakor zelo koristna, če nam omogočajo, da povečamo naša prizadevanja za pregled oddaje," doda.

Številni založniki in raziskovalne ustanove ga že uporabljajo Dokaz in ImageTwin. Na primer, znanstvene revije uporabljajo dokaz za preverjanje vprašanj integritete na slikah. Po besedah Meagana Phelana, direktorja komunikacij za znanost v Washingtonu DC, orodje še ni odkrilo nobenih slik, ki jih ustvari AI.

Springer Nature, Nature's Publisher, razvija lastna orodja za zaznavanje besedila in slike, imenovana Geppetto in Snapshot, ki zastavljajo nepravilnosti, ki jih nato ocenijo ljudje. (Ekipa Nature News je uredniško neodvisna od svojega založnika.)

Založniške skupine sprejemajo tudi ukrepe za odzivanje na slike, ki jih ustvari AI. Tiskovni predstavnik Mednarodnega združenja znanstvenih, tehničnih in medicinskih založnikov v Oxfordu v Veliki Britaniji je dejal United2act in središče STM Integrity, ki obravnava trenutna vprašanja z obveznim založništvom in drugimi vprašanji akademske integritete.

Christopher, ki vodi delovno skupino STM o spremembah in podvajanju slike, pravi, da se vedno večji zavedanje, da bo treba razviti načine za preverjanje surovih podatkov - na primer z označevanjem slik z mikroskopi z nevidnimi vodnimi znamkami, podobnimi tistim, ki so bili uporabljeni Vodni žigi v besedilih, ustvarjenih z A - To bi lahko bilo pravi način. To zahteva nove tehnologije in nove standarde za proizvajalce naprav, dodaja.

Patrick in drugi skrbijo, da založniki ne delujejo dovolj hitro, da bi rešili grožnjo. "Bojimo se, da bo to le še ena generacija težav v literaturi, ki jih ne obravnavajo, dokler ne bo prepozno," pravi.

Kljub temu so nekateri optimistični, da bodo v prihodnosti odkrili vsebino, ki se ustvarja v AI, ki se pojavljajo v člankih.

"Vse verjamem, da se bo tehnologija izboljšala do točke, ko prepozna podatke, ki se danes ustvarjajo - ker se bo v nekem trenutku to štelo za razmeroma grobo," pravi Patrick. "Goljufi ne bi smeli dobro spati ponoči. Lahko bi zavajali trenutni proces, vendar mislim, da procesa ne morejo za vedno zavajati."

-

Saguy, A. et al. Majhen met. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto