Obrázky generované AI ohrozujú vedu-takto ich vedci chcú rozpoznať

Vedci vo vedeckých publikáciách bojujú proti falošným obrazom generovaným AI. Vyvíjajú sa nové metódy detekcie.

Obrázky generované AI ohrozujú vedu-takto ich vedci chcú rozpoznať

Vedci manipulujú s číslami a hromadne vyrábajú falošné papiere Povinní vydavatelia - problematické rukopisy sú vo vedeckej literatúre už dlho nepríjemné. Vedeckí detektívi neúnavne pracujú, odhaliť tento priestupok a opraviť vedecký záznam. Ich práca sa však stáva čoraz ťažším, pretože sa objavil nový a výkonný nástroj pre podvodníkov: generatívny umelá inteligencia (Ai).

„Generatívna AI sa vyvíja veľmi rýchlo,“ hovorí Jana Christopher, Analytik Image Integrity Analyst v FEBS Press v Heidelbergu v Nemecku. „Ľudia, ktorí pracujú v mojej oblasti - integrita obrazu a politiky publikovania - sa čoraz viac obávajú možností, ktoré predstavuje.“

Ľahkosť, s ktorou Generatívne texty nástrojov AI, Obrázky a údaje vyvolávajú obavy zo stále nespoľahlivejšej vedeckej literatúry, zaplavenej falošnými číslami, rukopismi a závermi, ktoré sú pre ľudí ťažké odhaliť. Arms Race sa už objavuje ako špecialisti na integritu, vydavatelia a technologické spoločnosti usilovne pracujú Vypracujte nástroje AI, čo môže pomôcť rýchlo identifikovať klamlivé, prvky generované AI v špecializovaných článkoch.

„Je to desivý vývoj,“ hovorí Christopher. "Existujú však aj inteligentní ľudia a navrhujú sa dobré štrukturálne zmeny."

Odborníci v oblasti integrity výskumu uvádzajú, že hoci text generovaný AI už za určitých okolností povoľuje mnohými časopismi, pomocou takýchto nástrojov na vytváranie obrázkov alebo iných údajov sa môže považovať za menej prijateľné. "V blízkej budúcnosti môžeme byť v poriadku s textom generovaným AI," hovorí Alžbeth bik, špecialista na forenznú forenznú forenznosť a konzultant v San Franciscu v Kalifornii. "Ale kreslím čiaru, pokiaľ ide o generovanie údajov."

Bik, Christopher a ďalší naznačujú, že údaje vrátane obrázkov vytvorených s generatívnou AI sa už v literatúre používajú a že povinní vydavatelia používajú nástroje AI na výrobu rukopisov v objeme (pozri „Kvíz: Môžete si všimnúť ai falzifikáty?“).

Identifikácia obrázkov vyrobených AI predstavuje obrovskú výzvu: často je takmer nemožné odlíšiť od skutočných obrazov voľným okom. „Cítime sa, akoby sme narazili na AI generované obrázky každý deň,“ hovorí Christopher. "Ale pokiaľ to nedokážete, môžete urobiť naozaj veľmi málo."

Existuje niekoľko jasných príkladov použitia generatívnej AI vo vedeckých obrazoch, napríklad Teraz neslávny obraz potkana s absurdne veľkými genitálmi a nezmyselné štítky, vytvorené s nástrojom Midjourney Image. Grafika publikovaná časopisom Trade vo februári spôsobila búrku na sociálnych médiách a bola o pár dní neskôr stiahol.

Väčšina prípadov však nie je taká zrejmá. Obrázky vytvorené pomocou Adobe Photoshop alebo podobných nástrojov pred príchodom generatívnej AI - najmä v molekulárnej a bunkovej biológii - často obsahujú výrazné prvky, ktoré môžu byť rozpoznávané detektívmi, ako je identické pozadie alebo neobvyklý nedostatok pruhov alebo miest. Postavy generované AI často takéto charakteristiky nevykazujú. "Vidím veľa papierov, ktoré ma nútia myslieť si, že tieto západné bloty nevyzerajú skutočne - ale neexistuje fajčiarska pištoľ," hovorí Bik. „Všetko, čo môžete povedať, je, že jednoducho vyzerajú čudne, a samozrejme to nie je dostatok dôkazov na kontaktovanie editora.“

Existujú však náznaky, že znaky generované AI sa objavujú v publikovaných rukopisoch. Texty napísané pomocou nástrojov, ako je Chatgpt, sa zvyšujú v článkoch, čo je zrejmé z typických chatbotových fráz, ktoré autori zabudli odstrániť a výrazné slová, ktoré modely AI majú tendenciu používať. „Musíme teda predpokladať, že sa to stane aj pre údaje a obrázky,“ hovorí Bik.

Ďalším náznakom, že podvodníci používajú sofistikované zobrazovacie nástroje, je to, že väčšina problémov, ktoré vyšetrovatelia v súčasnosti zisťujú, sa objavujú v dielach, ktoré majú niekoľko rokov. „V posledných rokoch sme videli menej a menej problémov s obrázkami,“ hovorí Bik. "Myslím, že väčšina ľudí, ktorí boli chytení manipuláciou s obrázkami, začala vytvárať čistejšie obrázky."

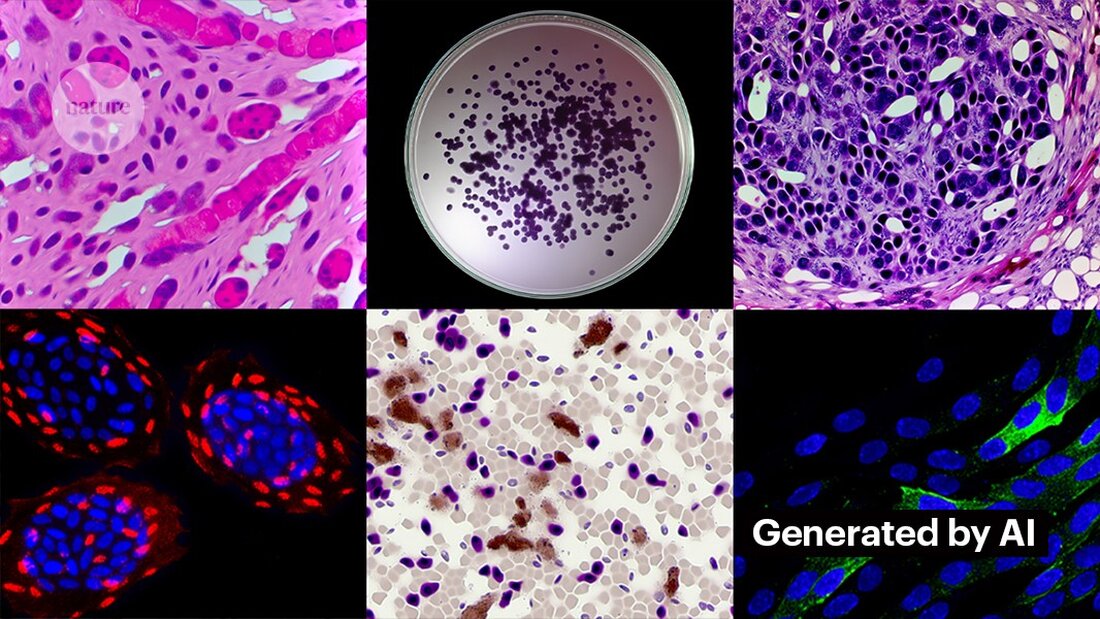

Vytváranie čistých obrázkov s generatívnou AI nie je ťažké. Kevin Patrick, vedecký detektív obrazu známy ako Cheshire na sociálnych médiách, preukázal, aké ľahké to môže byť, a zverejnil jeho zistenia na X. Použitím generatívnej výplne nástrojov Photoshop AI, Patrick vytvoril realistické obrazy - ktoré by sa mohli objaviť vo vedeckých papieroch - nádoroch, bunkových kultúrach, západných blotoch a ďalších. Vytvorenie väčšiny obrázkov trvalo menej ako minútu (pozri „Generovanie falošnej vedy“).

"Ak to dokážem, určite to urobia aj tí, ktorí sú platení za vytvorenie falošných údajov," hovorí Patrick. "Pravdepodobne existuje veľa ďalších údajov, ktoré by sa dali vygenerovať pomocou takýchto nástrojov."

Niektorí vydavatelia uvádzajú, že vo uverejnených štúdiách zistili dôkazy o obsahu generovanom AI. Patria sem PLOS, ktorý bol upozornený na podozrivý obsah a našiel dôkazy o texte a údajoch generovaných AI v článkoch a podaniach prostredníctvom interných vyšetrovaní, hovorí Renée Hoch, redaktor etického tímu PLOS v San Franciscu v Kalifornii. (Hoch poznamenáva, že použitie AI nie je zakázané v časopisoch PLOS a že politika AI je založená na zodpovednosti autorov a transparentných zverejneniach.)

Ďalšie nástroje by mohli poskytnúť aj príležitosti ľuďom, ktorí chcú vytvárať falošný obsah. Minulý mesiac vedci publikovali a 1 Generatívny model AI na vytvorenie snímok mikroskopu s vysokým rozlíšením-a niektorí špecialisti na integritu vyjadrili obavy z tejto práce. „Túto technológiu môžu ľahko využiť ľudia so zlými úmyslami na rýchle vytváranie stoviek alebo tisícov falošných obrázkov,“ hovorí Bik.

Yoav Shechtman z technologického inštitútu Technion-Israel v Haife, tvorca nástroja, tvrdí, že tento nástroj je užitočný na vytváranie výcvikových údajov pre modely, pretože obrázky mikroskopu s vysokým rozlíšením je ťažké získať. Dodáva však, že to nie je užitočné na generovanie falzifikátov, pretože používatelia majú malú kontrolu nad výsledkami. Existujúci softvér na úpravu obrázkov, ako je Photoshop, je užitočnejší pri manipulácii s figúrkami.

Aj keď ľudské oči nemusia byť schopné Rozpoznať obrázky generované AI, AI by to mohla urobiť (pozri „AI obrázky je ťažké rozpoznať“).

Vývojári nástrojov, ako sú Imagetwin a Proofig, ktoré používajú AI na detekciu problémov s integritou vo vedeckých obrázkoch, rozširujú svoj softvér na filtrovanie obrázkov vytvorených generatívnou AI. Pretože takéto obrázky je také ťažké rozpoznať, obe spoločnosti vytvárajú svoje vlastné databázy generatívnych AI obrázkov na školenie svojich algoritmov.

Spoločnosť Proofig už vydala funkciu vo svojom nástroji na rozpoznávanie snímok mikroskopu generovaných AI. Spoluzakladateľ Dror Kolodkin-Gal v Rehovot v Izraeli hovorí, že pri testovaní s tisíckami AI generovaných a skutočných obrazov z článkov algoritmus správne identifikoval AI obrazy 98% času a mal falošnú pozitívnu rýchlosť 0,02%. Dor dodáva, že tím sa teraz snaží pochopiť, čo presne zistí ich algoritmus.

„Mám veľké nádeje na tieto nástroje,“ hovorí Christopher. Poznamenáva však, že ich výsledky musia vždy vyhodnotiť odborníci, ktorí môžu overiť problémy, ktoré naznačujú. Christopher ešte nevidel žiadne dôkazy o tom, že softvér na rozpoznávanie obrázkov AI je spoľahlivý (interné hodnotenie spoločnosti Proofig ešte nebolo uverejnené). Tieto nástroje sú „obmedzené, ale určite veľmi užitočné, keď nám umožňujú škálovať naše úsilie o preskúmanie podania,“ dodáva.

Mnoho vydavateľov a výskumné inštitúcie ho už používa Dôkaz a Imageswin. Napríklad vedecké časopisy používajú Proofig na kontrolu problémov s integritou v obrázkoch. Podľa Meagana Phelana, riaditeľa komunikácie pre vedu vo Washingtone DC, tento nástroj ešte neobjavil žiadne obrázky generované AI.

Springer Nature, vydavateľ prírody, vyvíja svoje vlastné nástroje na detekciu textu a obrazov, ktoré sa nazývajú Geppetto a snímka, ktoré označujú nezrovnalosti, ktoré potom vyhodnocujú ľudia. (Tím spoločnosti Nature News je redakčne nezávislý od svojho vydavateľa.)

Publikované skupiny tiež podnikajú kroky na reagovanie na obrázky generované AI. Hovorca Medzinárodnej asociácie vydavateľov vedeckých, technických a lekárskych (STM) v Oxforde vo Veľkej Británii uviedol, že túto otázku berie „veľmi vážne“ a reagoval na iniciatívy, ako napríklad iniciatívy United2Act a centrum integrity STM, ktoré sa zaoberá súčasnými problémami s povinným publikovaním a ďalšími problémami akademickej integrity.

Christopher, ktorý vedie pracovnú skupinu STM o zmenách a duplikáciách obrazu, tvrdí, že rastie povedomie, že bude potrebné vyvinúť spôsoby, ako overiť prvotné údaje - napríklad označením snímok nasnímaných mikroskopu s neviditeľnými vodoznakmi podobnými použitým Vodoznaky v textoch generovaných AI - To by mohol byť správny spôsob. Vyžaduje si to nové technológie a nové štandardy pre výrobcov zariadení, dodáva.

Patrick a ďalší sa obávajú, že vydavatelia nekonajú dostatočne rýchlo, aby riešili hrozbu. „Obávame sa, že to bude len ďalšia generácia problémov v literatúre, ktorú sa neriešia, kým nebude neskoro,“ hovorí.

Niektorí sú však optimistickí, že obsah generovaný AI, ktorý sa dnes objaví v článkoch, bude objavený v budúcnosti.

„Mám každú istotu, že táto technológia sa zlepší do bodu, keď uznáva údaje, ktoré sa dnes vytvárajú - pretože to sa v určitom okamihu bude považovať za relatívne hrubé,“ hovorí Patrick. „Podvodníci by nemali v noci dobre spať. Mohli by oklamať súčasný proces, ale nemyslím si, že by mohli tento proces oklamať navždy.“

-

Saguy, A. a kol. Malý pervit. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto