AI radītie attēli apdraud zinātni – šādi pētnieki vēlas tos atpazīt

Pētnieki cīnās pret mākslīgā intelekta radītiem viltus attēliem zinātniskās publikācijās. Attīstās jaunas noteikšanas metodes.

AI radītie attēli apdraud zinātni – šādi pētnieki vēlas tos atpazīt

Zinātnieki manipulē ar skaitļiem un masveidā ražo viltotus papīrus Obligātie izdevēji – problemātiskie manuskripti jau sen ir traucēkli zinātniskajā literatūrā. Zinātniskie detektīvi strādā nenogurstoši, lai atklātu šo pārkāpumu un labotu zinātnisko ierakstu. Taču viņu darbs kļūst arvien grūtāks, jo ir parādījies jauns, spēcīgs instruments krāpniekiem: ģeneratīvais mākslīgais intelekts (AI).

"Ģeneratīvā AI attīstās ļoti ātri," saka Jana Kristofers, attēla integritātes analītiķis FEBS Press Heidelbergā, Vācijā. "Cilvēki, kas strādā manā apgabalā — attēla integritāte un publicēšanas politika — arvien vairāk uztraucas par tā sniegtajām iespējām."

Vieglums, ar kuru ģeneratīvo AI rīku teksti, attēli un dati rada bažas par arvien neuzticamāku zinātnisko literatūru, ko pārpludina viltus numuri, manuskripti un secinājumi, kurus cilvēkiem ir grūti atklāt. Jau tagad veidojas bruņošanās sacīkstes, pie kuras rūpīgi strādā integritātes speciālisti, izdevēji un tehnoloģiju uzņēmumi Izstrādāt AI rīkus, kas speciālistu rakstos var palīdzēt ātri identificēt maldinošus, mākslīgā intelekta radītus elementus.

"Tā ir biedējoša attīstība," saka Kristofers. "Bet ir arī gudri cilvēki un tiek piedāvātas labas strukturālas izmaiņas."

Pētījumu integritātes eksperti ziņo, ka, lai gan AI ģenerēts teksts noteiktos apstākļos jau ir atļauts daudzos žurnālos, šādu rīku izmantošana attēlu vai citu datu radīšanai var tikt uzskatīta par mazāk pieņemamu. "Tuvākajā nākotnē, iespējams, mums būs labi ar AI ģenerētu tekstu," saka Elizabete Bika, attēlu kriminālistikas speciālists un konsultants Sanfrancisko, Kalifornijā. "Bet es novelku robežu, kad runa ir par datu ģenerēšanu."

Biks, Kristofers un citi norāda, ka dati, tostarp attēli, kas izveidoti ar ģeneratīvo AI, jau tiek plaši izmantoti literatūrā un ka obligātie izdevēji izmanto AI rīkus, lai sagatavotu manuskriptus apjomā (skatiet sadaļu “Viktorīna: vai varat pamanīt AI viltojumus?”).

AI radīto attēlu identificēšana ir milzīgs izaicinājums: tos bieži ir gandrīz neiespējami atšķirt no reāliem attēliem ar neapbruņotu aci. "Mums šķiet, ka katru dienu sastopamies ar mākslīgā intelekta radītiem attēliem," saka Kristofers. "Bet, ja vien jūs to nevarat pierādīt, jūs varat darīt ļoti maz."

Ir daži skaidri piemēri ģeneratīvā AI izmantošanai zinātniskos attēlos, piemēram, tagad bēdīgi slavenais žurkas tēls ar absurdi lieliem dzimumorgāniem un muļķīgas etiķetes, kas izveidotas ar Midjourney attēlu rīku. Grafika, ko februārī publicēja tirdzniecības žurnāls, izraisīja vētru sociālajos tīklos un bija izņemts pēc dažām dienām.

Tomēr vairums gadījumu nav tik acīmredzami. Skaitļi, kas izveidoti, izmantojot Adobe Photoshop vai līdzīgus rīkus pirms ģeneratīvā AI parādīšanās, jo īpaši molekulārajā un šūnu bioloģijā, bieži satur pārsteidzošas iezīmes, kuras detektīvi var atpazīt, piemēram, identisks fons vai neparasts svītru vai plankumu trūkums. AI radītās rakstzīmes bieži neuzrāda šādas īpašības. "Es redzu daudz dokumentu, kas liek man domāt, ka šie Western bloti neizskatās īsti, taču nav smēķēšanas pistoles," saka Biks. "Var teikt tikai to, ka viņi vienkārši izskatās dīvaini, un, protams, tas nav pietiekami pierādījumi, lai sazinātos ar redaktoru."

Tomēr ir pazīmes, ka publicētajos manuskriptos parādās mākslīgā intelekta radīti varoņi. Rakstu skaits, kas rakstīts, izmantojot tādus rīkus kā ChatGPT, pieaug, par ko liecina tipiskas tērzēšanas robotu frāzes, kuras autori aizmirst noņemt, un atšķirīgi vārdi, kurus AI modeļi mēdz izmantot. "Tāpēc mums ir jāpieņem, ka tas notiek arī datiem un attēliem," saka Biks.

Vēl viena norāde uz to, ka krāpnieki izmanto sarežģītus attēlveidošanas rīkus, ir tas, ka lielākā daļa problēmu, ko izmeklētāji pašlaik atklāj, parādās darbos, kas ir vairākus gadus veci. "Pēdējos gados mēs esam redzējuši arvien mazāk problēmu ar attēliem," saka Biks. "Es domāju, ka lielākā daļa cilvēku, kuri tika pieķerti, manipulējot ar attēliem, sāka radīt tīrākus attēlus."

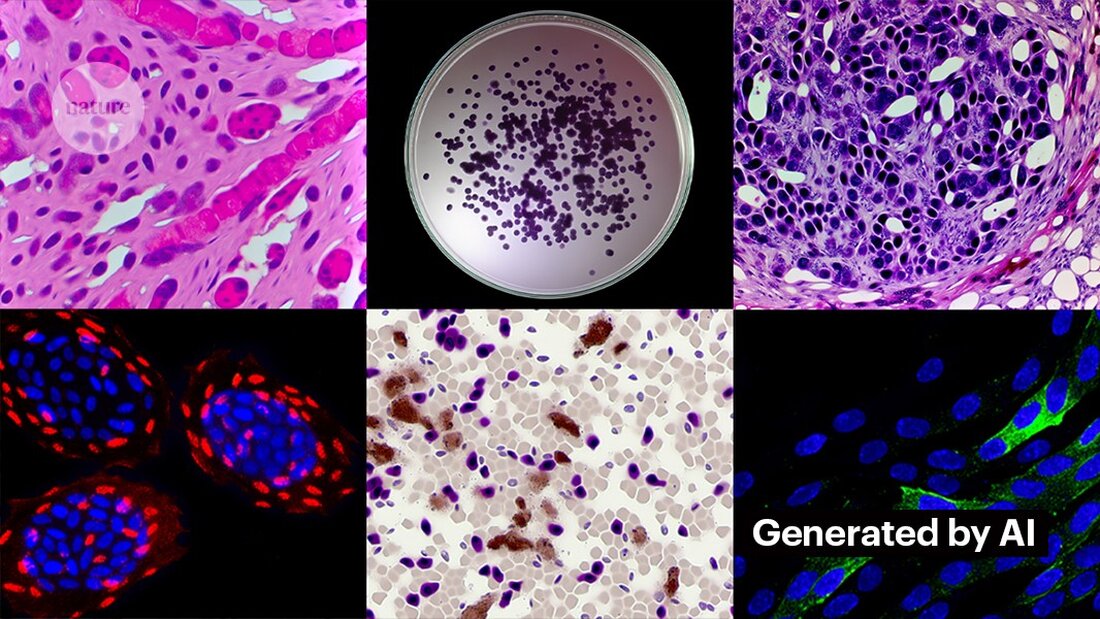

Tīru attēlu izveide ar ģeneratīvu AI nav grūta. Kevins Patriks, zinātniskais attēlu detektīvs, kas sociālajos medijos pazīstams kā Češīra, ir parādījis, cik viegli tas var būt, un publicējis savus atklājumus vietnē X. Izmantojot Photoshop AI rīku Generatīvā aizpilde, Patriks izveidoja reālistiskus attēlus, kas varētu parādīties zinātniskos rakstos, ar audzējiem, šūnu kultūrām, Western blot un citiem. Lielākajai daļai attēlu izveidošana aizņēma mazāk nekā minūti (skatiet “Viltus zinātnes ģenerēšana”).

"Ja es to varu izdarīt, tad noteikti to darīs arī tie, kuriem maksā par viltotu datu izveidi," saka Patriks. "Iespējams, ir daudz citu datu, ko varētu ģenerēt, izmantojot tādus rīkus kā šis."

Daži izdevēji ziņo, ka publicētajos pētījumos ir atraduši pierādījumus par AI radītu saturu. Tas ietver PLoS, kas ir brīdināts par aizdomīgu saturu un ir atradis pierādījumus par mākslīgā intelekta radītu tekstu un datiem rakstos un iesniegumos, izmantojot iekšējo izmeklēšanu, saka Renée Hoch, PLoS publikāciju ētikas komandas redaktors Sanfrancisko, Kalifornijā. (Hoch atzīmē, ka AI izmantošana nav aizliegta PLoS žurnālos un ka AI politika ir balstīta uz autora atbildību un pārredzamu izpaušanu.)

Citi rīki varētu sniegt iespējas arī cilvēkiem, kuri vēlas izveidot viltotu saturu. Pagājušajā mēnesī pētnieki publicēja a 1 ģeneratīvais AI modelis, lai izveidotu augstas izšķirtspējas mikroskopa attēlus, un daži integritātes speciālisti pauda bažas par šo darbu. "Šo tehnoloģiju var viegli izmantot cilvēki ar sliktiem nodomiem, lai ātri izveidotu simtiem vai tūkstošiem viltotu attēlu," saka Biks.

Yoav Shechtman no Technion-Israel Tehnoloģiju institūta Haifā, rīka radītājs, saka, ka rīks ir noderīgs, lai izveidotu modeļu apmācības datus, jo augstas izšķirtspējas mikroskopa attēlus ir grūti iegūt. Taču viņš piebilst, ka tas nav lietderīgi viltojumu ģenerēšanai, jo lietotājiem ir maza kontrole pār rezultātiem. Esošā attēlu rediģēšanas programmatūra, piemēram, Photoshop, ir noderīgāka, lai manipulētu ar figūrām, viņš iesaka.

Lai gan cilvēka acis var nespēt Atpazīt AI radītos attēlus, AI, iespējams, to varētu izdarīt (skatiet “AI attēlus ir grūti atpazīt”).

Tādu rīku kā Imagetwin un Proofig izstrādātāji, kas izmanto AI, lai atklātu zinātnisko attēlu integritātes problēmas, paplašina savu programmatūru, lai filtrētu attēlus, kas izveidoti ar ģeneratīvo AI. Tā kā šādus attēlus ir tik grūti atpazīt, abi uzņēmumi veido savas ģeneratīvo AI attēlu datu bāzes, lai apmācītu savus algoritmus.

Proofig savā rīkā jau ir izlaidusi funkciju mākslīgā intelekta radīto mikroskopa attēlu atpazīšanai. Līdzdibinātājs Drors Kolodkins-Gals Rehovotā, Izraēlā, saka, ka, pārbaudot tūkstošiem AI ģenerētu un reālu attēlu no rakstiem, algoritms pareizi identificēja AI attēlus 98% gadījumu un tam bija kļūdaini pozitīvs rādītājs 0,02%. Drors piebilst, ka komanda tagad cenšas saprast, ko tieši viņu algoritms atklāj.

"Es ļoti ceru uz šiem instrumentiem," saka Kristofers. Viņa gan atzīmē, ka to rezultāti vienmēr ir jāizvērtē ekspertiem, kuri var pārbaudīt viņu norādītās problēmas. Kristofers vēl nav redzējis nekādus pierādījumus, ka AI attēlu atpazīšanas programmatūra ir uzticama (Proofig iekšējais novērtējums vēl nav publicēts). Šie rīki ir “ierobežoti, taču noteikti ir ļoti noderīgi, lai mēs varētu mērogot mūsu iesniegumu pārskatīšanas centienus,” viņa piebilst.

Daudzi izdevēji un pētniecības iestādes to jau izmanto Pierādījums un Imagetwin. Piemēram, zinātnes žurnāli izmanto Proofig, lai pārbaudītu attēlu integritātes problēmas. Saskaņā ar Vašingtonas Zinātnes komunikāciju direktora Meagan Phelan teikto, rīks vēl nav atklājis nevienu AI ģenerētu attēlu.

Springer Nature, Nature izdevējs, izstrādā savus teksta un attēlu noteikšanas rīkus, ko sauc par Geppetto un SnapShot, kas norāda uz pārkāpumiem, kurus pēc tam novērtē cilvēki. (Dabas ziņu komanda ir redakcionāli neatkarīga no izdevēja.)

Izdevēju grupas arī veic pasākumus, lai reaģētu uz AI ģenerētiem attēliem. Starptautiskās Zinātnisko, tehnisko un medicīnas izdevēju asociācijas (STM) pārstāvis Oksfordā, Apvienotajā Karalistē, sacīja, ka tā šo jautājumu uztver "ļoti nopietni" un reaģē uz tādām iniciatīvām kā United2Act un STM Integrity Hub, kas risina aktuālas problēmas saistībā ar obligāto publicēšanu un citiem akadēmiskās integritātes jautājumiem.

Kristofers, kurš vada STM darba grupu par attēlu izmaiņām un dublēšanu, saka, ka pieaug izpratne par to, ka būs nepieciešams izstrādāt veidus, kā pārbaudīt neapstrādātus datus, piemēram, marķējot ar mikroskopiem uzņemtos attēlus ar neredzamām ūdenszīmēm, kas ir līdzīgas izmantotajām. Ūdenszīmes mākslīgā intelekta radītajos tekstos – tas varētu būt pareizais ceļš. Viņa piebilst, ka tas prasa jaunas tehnoloģijas un jaunus standartus ierīču ražotājiem.

Patriks un citi uztraucas, ka izdevēji nerīkojas pietiekami ātri, lai novērstu draudus. "Mēs baidāmies, ka tā būs tikai kārtējā literatūras problēmu paaudze, ko viņi nerisina, kamēr nav par vēlu," viņš saka.

Tomēr daži ir optimistiski, ka AI radītais saturs, kas šodien parādās rakstos, tiks atklāts nākotnē.

"Man ir pilnīga pārliecība, ka tehnoloģija uzlabosies tiktāl, ka tā atpazīst šodien izveidotos datus, jo kādā brīdī tos uzskatīs par samērā rupju," saka Patriks. "Krāpniekiem nevajadzētu labi gulēt naktīs. Viņi varētu apmānīt pašreizējo procesu, bet es nedomāju, ka viņi var apmuļķot procesu uz visiem laikiem."

-

Saguy, A. et al. Mazais met. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto