AI-generoituja kuvia vaarantaa tiedettä-näin tutkijat haluavat tunnistaa ne

Tutkijat taistelevat tieteellisissä julkaisuissa AI-tuotettuja väärennettyjä kuvia. Uusia havaitsemismenetelmiä kehitetään.

AI-generoituja kuvia vaarantaa tiedettä-näin tutkijat haluavat tunnistaa ne

Tutkijat, jotka manipuloivat lukuja ja massatuotantoa väärennettyjä papereita Pakolliset kustantajat - Ongelmalliset käsikirjoitukset ovat jo pitkään olleet haittaa tieteellisessä kirjallisuudessa. Tieteelliset etsivät työskentelevät väsymättä, paljastaa tämä väärinkäytökset ja korjata tieteellinen tietue. Mutta heidän työnsä on tulossa yhä vaikeammaksi, koska uusi, tehokas petostyökalu on syntynyt: generatiivi tekoäly (AI).

"Generatiivinen AI kehittyy hyvin nopeasti", sanoo Jana Christopher, Kuvan eheysanalyytikko FEBS Pressissa Heidelbergissä, Saksassa. "Alueellani työskentelevät ihmiset - kuvan eheys ja julkaisumus politiikat - ovat yhä huolestuneempia mahdollisuuksista, joita se tarjoaa."

Helppous generatiiviset AI -työkalut tekstit, Kuvat ja tiedot herättävät pelkoja yhä epäluotettavimmasta tieteellisestä kirjallisuudesta, joka on tulvitettu väärennöksillä, käsikirjoituksilla ja johtopäätöksillä, joita ihmisten on vaikea havaita. Asekilpailu on jo syntymässä rehellisyyden asiantuntijoina, kustantajina ja teknologiayrityksillä, jotka työskentelevät ahkerasti Kehitä AI -työkaluja, joka voi auttaa nopeasti tunnistamaan harhaanjohtavia, AI-tuotettuja elementtejä erikoistuneissa artikkeleissa.

"Se on pelottava kehitys", Christopher sanoo. "Mutta ehdotetaan myös älykkäitä ihmisiä ja hyviä rakenteellisia muutoksia."

Tutkimuksen eheyden asiantuntijat ilmoittavat, että vaikka monien aikakauslehtien AI: n tuottama teksti on jo sallittu tietyissä olosuhteissa, kuvien tai muiden tietojen luomiseen voidaan pitää vähemmän hyväksyttävää. "Lähitulevaisuudessa saatamme olla kunnossa AI-luomalla tekstillä", sanoo Elisabeth Bik, Image Forensics -asiantuntija ja konsultti San Franciscossa, Kaliforniassa. "Mutta piirrän viivan tietojen luomisessa."

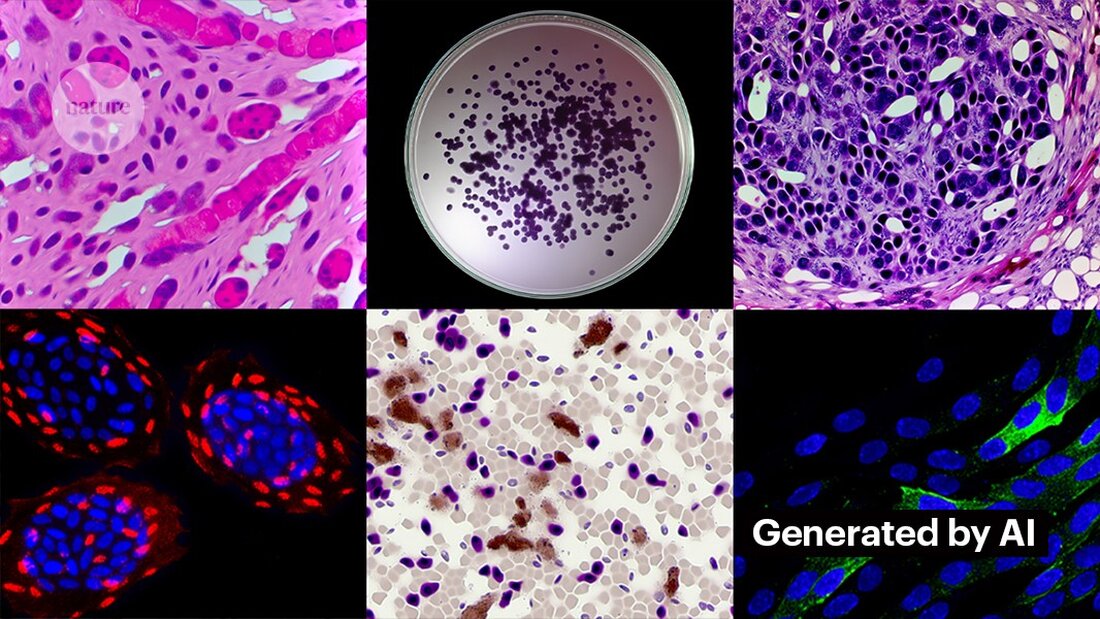

Bik, Christopher ja muut ehdottavat, että generatiivisella AI: llä luotuja tietoja käytetään jo laajasti kirjallisuudessa ja että pakolliset kustantajat käyttävät AI -työkaluja käsikirjoitusten tuottamiseen (katso 'Tietokilpailu: Voitko havaita AI -vääriä? ").

AI: n tuottamien kuvien tunnistaminen asettaa valtavan haasteen: niitä on usein melkein mahdotonta erottaa todellisista kuvista paljaalla silmällä. "Tuntuu siltä, että törmäämme AI-luomaan kuviin joka päivä", Christopher sanoo. "Mutta ellet pysty todistamaan sitä, voit tehdä todella vähän."

Tieteellisissä kuvissa on joitain selkeitä esimerkkejä generatiivisen AI: n käytöstä, kuten Nyt surullisen kuvan rotasta, jolla on järjetöntä suuria sukupuolielimiä ja järjetöntä tarraa, jotka on luotu Midjourney Image -työkalulla. Kaupan lehden helmikuussa julkaisema grafiikka aiheutti myrskyn sosiaalisessa mediassa ja oli peruutettu muutamaa päivää myöhemmin.

Useimmat tapaukset eivät kuitenkaan ole niin ilmeisiä. Adobe Photoshop -sovelluksen tai vastaavien työkalujen avulla luodut luvut ennen generatiivisen AI: n tulemista - etenkin molekyyli- ja solubiologiassa - sisältävät usein silmiinpistäviä piirteitä, jotka detektiivit voivat tunnistaa, kuten identtiset taustat tai epätavalliset raidojen tai pisteiden puute. AI: n tuotetut merkit eivät usein osoita sellaisia ominaisuuksia. "Näen paljon papereita, jotka saavat minut ajattelemaan, että nämä Western -blotit eivät näytä todellisilta - mutta tupakointipistoolia ei ole", Bik sanoo. "Voit sanoa vain, että ne näyttävät vain oudolta, ja tietysti se ei ole tarpeeksi todisteita ottamaan yhteyttä toimittajaan."

On kuitenkin merkkejä siitä, että AI-tuotetut merkit esiintyvät julkaistuissa käsikirjoituksissa. CHATGPT: n kaltaisilla työkaluilla kirjoitetut tekstit kasvavat artikkeleissa, mikä ilmenee tyypillisillä chatbot -lauseilla, jotka kirjoittajat unohtavat poistaa ja erottuvat sanat, joita AI -mallit yleensä käyttävät. "Joten meidän on oletettava, että tämä tapahtuu myös tiedoille ja kuville", Bik sanoo.

Toinen osoitus siitä, että petokset käyttävät hienostuneita kuvantamistyökaluja, on se, että suurin osa tutkijoiden löytämistä ongelmista esiintyy tällä hetkellä useita vuosia vanhoja teoksia. "Viime vuosina olemme nähneet vähemmän ja vähemmän kuvien ongelmia", Bik sanoo. "Uskon, että suurin osa ihmisistä, jotka saivat manipuloida kuvia, alkoi luoda puhdistusainetta."

Puhtaiden kuvien luominen generatiivisella AI: lla ei ole vaikeaa. Kevin Patrick, tieteellinen kuvadetektiivi, joka tunnetaan nimellä Cheshire sosiaalisessa mediassa, on osoittanut, kuinka helppoa se voi olla, ja julkaissut havaintonsa X: llä. Käyttämällä Photoshopin AI -työkalujen generatiivista täyttöä, Patrick loi realistisia kuvia - jotka voisivat esiintyä tieteellisissä papereissa - kasvaimista, solukulttuurista, Western Blotsista ja muusta. Useimpien kuvien luominen kesti vähemmän kuin minuutti (katso 'väärän tieteen luominen').

"Jos voin tehdä niin, niin varmasti ne, jotka maksetaan väärennettyjen tietojen luomiseksi, tekevät sen myös", Patrick sanoo. "On todennäköisesti paljon muuta tietoa, joka voitaisiin luoda tällaisilla työkaluilla."

Jotkut kustantajat ilmoittavat löytävänsä todisteita AI-tuotetusta sisällöstä julkaistuissa tutkimuksissa. Tähän sisältyy PLoS, jota on ilmoitettu epäilyttävästä sisällöstä ja löydetty todisteita AI: n tuotetusta tekstistä ja tiedoista artikkeleissa ja huomautuksissa sisäisten tutkimusten kautta, sanoo PLOS: n julkaisun etiikkatiimin toimittaja Renée Hoch San Franciscossa, Kaliforniassa. (Hoch toteaa, että AI: n käyttöä ei ole kielletty PLOS -lehdissä ja että AI -politiikka perustuu tekijän vastuulle ja avoimiin tietoihin.)

Muut työkalut voisivat tarjota myös mahdollisuuksia ihmisille, jotka haluavat luoda väärennetyn sisällön. Viime kuussa tutkijat julkaisivat a 1 Generatiivinen AI-malli korkearesoluutioisten mikroskooppikuvien luomiseksi-ja jotkut eheyden asiantuntijat ilmaisivat huolensa tästä työstä. "Tätä tekniikkaa voivat helposti käyttää huonoja aikomuksia luomaan nopeasti satoja tai tuhansia vääriä kuvia", Bik sanoo.

Työkalun luoja Haifan Technion-Israel Institute of Technion-Israel Institute Yoav Shechtman sanoo, että työkalu on hyödyllinen mallejen koulutustietojen luomisessa, koska korkearesoluutioisten mikroskooppikuvien on vaikea saada. Mutta hän lisää, että siitä ei ole hyötyä väärennösten luomisessa, koska käyttäjillä ei ole juurikaan hallintaa tuloksista. Hän ehdottaa olemassa olevia kuvanmuokkausohjelmistoja, kuten Photoshop, on hyödyllisempi hahmojen manipuloinnissa.

Vaikka ihmisen silmät eivät ehkä pysty Tunnista AI-generoituja kuvia, AI voisi mahdollisesti tehdä tämän (katso 'AI -kuvia on vaikea tunnistaa').

ImageTwinin ja Proticig -kaltaisten työkalujen kehittäjät, jotka käyttävät AI: tä tieteellisten kuvien eheysongelmien havaitsemiseen, laajentavat ohjelmistoaan generatiivisen AI: n luomien kuvien suodattamiseksi. Koska tällaisia kuvia on niin vaikea tunnistaa, molemmat yritykset luovat omia tietokantoja generatiivisista AI -kuvista algoritmien kouluttamiseksi.

Procieg on jo julkaissut ominaisuuden työkalussaan AI-generoitujen mikroskooppikuvien tunnistamiseksi. Israelin Rehovon perustaja Dror Kolodkin-Gal sanoo, että testattaessa tuhansilla AI: n tuotetuilla ja todellisilla kuvilla artikkeleista, algoritmi tunnisti oikein AI-kuvat 98% ajasta ja sen väärä positiivinen nopeus oli 0,02%. Dror lisää, että joukkue yrittää nyt ymmärtää, mitä heidän algoritminsa tarkalleen havaitsee.

"Minulla on suuria toiveita näistä työkaluista", Christopher sanoo. Hän toteaa kuitenkin, että asiantuntijoiden on aina arvioitava heidän tuloksensa, jotka voivat tarkistaa heidän ilmoittamansa ongelmat. Christopher ei ole vielä nähnyt mitään todisteita siitä, että AI -kuvantunnistusohjelmisto on luotettava (Proviginin sisäistä arviointia ei ole vielä julkaistu). Nämä työkalut ovat ”rajoitettuja, mutta varmasti erittäin hyödyllisiä, kun voimme skaalata lähetysten tarkistuspyrkimyksiä”, hän lisää.

Monet kustantajat ja tutkimuslaitokset käyttävät sitä jo Todiste ja ImageTwin. Esimerkiksi tieteelliset lehdet tarkistavat kuvien eheysongelmat. Washington DC: n viestinnän johtajan Meagan Phelanin mukaan työkalu ei ole vielä löytänyt mitään AI: n tuotettuja kuvia.

Luonnon kustantaja Springer Nature kehittää omia teksti- ja kuvantunnistustyökalujaan, nimeltään Geppetto ja Snapshot, jotka lipunvat epäsäännöllisyydet, jotka ihmiset sitten arvioivat. (Nature News -tiimi on toimituksellisesti riippumaton kustantajastaan.)

Kustantamaryhmät ryhtyvät myös toimiin reagoidakseen AI: n luomiin kuviin. Ison -Britannian Oxfordissa, Iso -Britanniassa sijaitsevan tieteellisen, teknisen ja lääketieteellisen (STM) kustantajan kansainvälisen tieteellisen, teknisen ja lääketieteellisen (STM) kustantajan edustaja kertoi asiasta "erittäin vakavasti" ja reagoi aloitteisiin, kuten esimerkiksi United2act ja STM Integrity Hub, joka käsittelee nykyisiä kysymyksiä pakollisissa julkaisuissa ja muissa akateemisissa eheyskysymyksissä.

Christopher, joka johtaa STM: n työryhmää kuvanmuutoksia ja päällekkäisyyksiä, sanoo kasvavan tietoisuuden siitä, että on tarpeen kehittää tapoja tarkistaa raakadata - esimerkiksi merkitsemällä kuvat, jotka on otettu mikroskoopeilla näkymättömillä vesileimoilla, jotka ovat samanlaisia kuin käytetyt Vesileimat AI: n tuotetuissa teksteissä - Se voi olla oikea tapa. Tämä vaatii uusia tekniikoita ja uusia standardeja laitevalmistajille, hän lisää.

Patrick ja muut ovat huolissaan siitä, että kustantajat eivät toimi riittävän nopeasti uhkaan vastaamiseksi. "Pelkäämme, että tämä on vain yksi kirjallisuuden ongelmia, joihin he eivät käsittele, ennen kuin on liian myöhäistä", hän sanoo.

Jotkut ovat silti optimistisia, että nykyään artikkeleissa esiintyvä AI-luoma sisältö löydetään tulevaisuudessa.

"Olen luottavainen siihen, että tekniikka paranee siihen pisteeseen, että se tunnistaa tänään luodut tiedot - koska sitä pidetään jossain vaiheessa suhteellisen karkeasti", Patrick sanoo. "Petosten ei pitäisi nukkua hyvin yöllä. He voisivat huijata nykyistä prosessia, mutta en usko, että he voivat huijata prosessia ikuisesti."

-

Saguy, A. et ai. Pieni met. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto