Obrázky generované AI, které ohrožují vědu-Takto je vědci chtějí rozpoznat

Vědci bojují proti falešným obrazům generovaným AI ve vědeckých publikacích. Vyvíjí se nové metody detekce.

Obrázky generované AI, které ohrožují vědu-Takto je vědci chtějí rozpoznat

Vědci manipulují s čísly a hromadné produkce falešných papírů Povinné vydavatelé - Problematické rukopisy jsou ve vědecké literatuře již dlouho obtěžováním. Vědecké detektivové neúnavně pracují, odhalit toto protiprávní jednání a opravit vědecký záznam. Jejich práce je však stále obtížnější, protože se objevil nový, mocný nástroj pro podvodníky: generativní Umělá inteligence (AI).

"Generative AI se vyvíjí velmi rychle," říká Jana Christopher, Analytik integrity obrázků v FEBS Press v Heidelbergu v Německu. "Lidé, kteří pracují v mé oblasti - integrita image a politiky publikování - se stále více zajímají o možnosti, které představuje."

Snadnost, s níž Generativní texty nástrojů AI, obrázky a údaje vyvolávají obavy z stále nespolehlivější vědecké literatury, zaplavené falešnými čísly, rukopisy a závěry, které jsou pro lidi obtížné odhalit. Zrušení se již objevuje jako specialisté na integritu, vydavatelé a technologické společnosti usilovně pracují Vypracovat nástroje AI, což může pomoci rychle identifikovat klamné prvky generované AI ve specializovaných článcích.

"Je to děsivý vývoj," říká Christopher. "Ale jsou navrženy také inteligentní lidé a dobré strukturální změny."

Odborníci na integritu výzkumu uvádějí, že ačkoliv text generovaný AI je již za určitých okolností povolen mnoha časopisy, použití takových nástrojů k vytváření obrázků nebo jiných údajů lze považovat za méně přijatelné. "V blízké budoucnosti můžeme být v pořádku s textem generovaným AI," říká Elisabeth Bik, Specialista na forenzní forenzní a konzultant v San Franciscu v Kalifornii. "Ale nakreslím čáru, pokud jde o generování dat."

BIK, Christopher a další naznačují, že data, včetně obrázků, vytvořená s generativní AI, se již v literatuře široce používají a že povinní vydavatelé používají nástroje AI k výrobě objemových rukopisů (viz „Kvíz: můžete spatřit padělky AI?“).

Identifikace obrázků produkovaných AI představuje obrovskou výzvu: často je téměř nemožné odlišit od skutečných obrazů pouhým okem. "Máme pocit, že každý den narazíme na obrázky generované AI," říká Christopher. "Ale pokud to nedokážete, je opravdu velmi málo, co můžete udělat."

Existuje několik jasných příkladů použití generativní AI ve vědeckých obrazech, jako je nyní neslavný obraz krysy s absurdně velkými genitáliemi a nesmyslné štítky, vytvořené s nástrojem Midjourney Image. Grafika, publikovaná obchodním časopisem v únoru, způsobila bouři na sociálních médiích a byla stažen o několik dní později.

Většina případů však není tak zřejmá. Obrázky vytvořené pomocí Adobe Photoshopu nebo podobných nástrojů před příchodem generativní AI - zejména v molekulární a buněčné biologii - často obsahují výrazné rysy, které mohou být rozpoznány detektivy, jako je identické pozadí nebo neobvyklý nedostatek pruhů nebo skvrn. Postavy generované AI často takové vlastnosti nevykazují. "Vidím spoustu papírů, které mě nutí myslet si, že tyto západní bloty nevypadají skutečně - ale neexistuje žádná kouření," říká Bik. "Jediné, co můžete říci, je, že vypadají divně a samozřejmě to není dost důkazů, aby se obrátil na editora."

Existují však náznaky, že se znaky generované AI objevují ve publikovaných rukopisech. Texty napsané pomocí nástrojů, jako je ChatGPT, rostou v článcích, které jsou patrné typickými chatbot frázemi, na které autoři zapomínají odstranit a výrazná slova, která modely AI mají tendenci používat. "Musíme tedy předpokládat, že k tomu dochází také pro data a obrázky," říká Bik.

Další náznak toho, že podvodníci používají sofistikované zobrazovací nástroje, je to, že většina problémů vyšetřovatelé v současné době nacházejí v dílech, která jsou několik let stará. "V posledních letech jsme viděli méně a méně problémů s obrázky," říká Bik. "Myslím, že většina lidí, kteří byli chyceni manipulačními obrázky, začala vytvářet čistší obrázky."

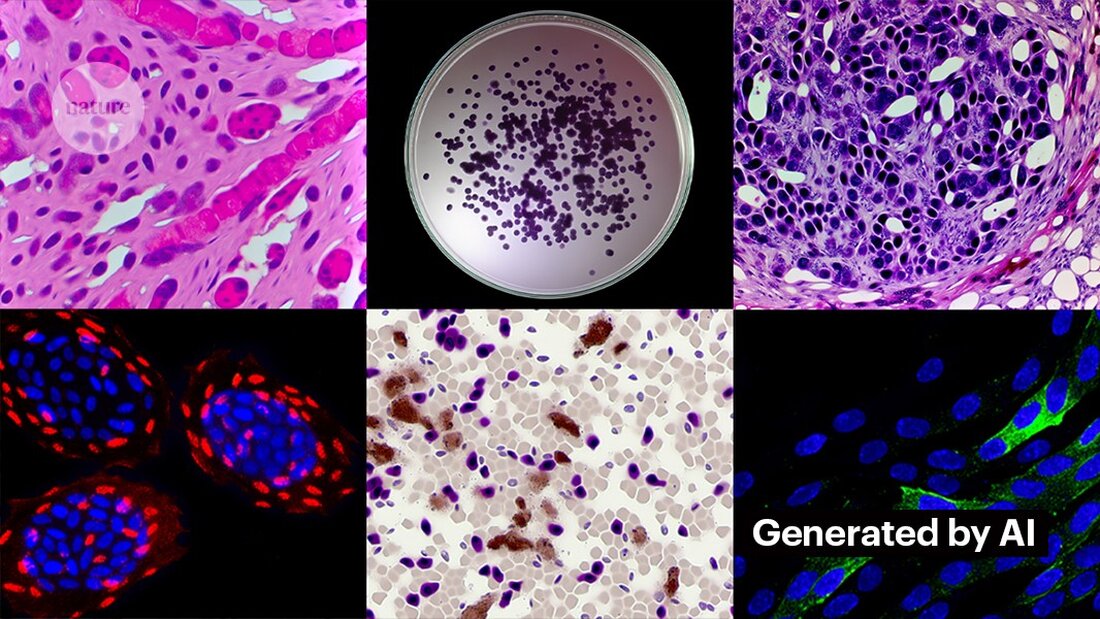

Vytváření čistých obrázků s generativní AI není obtížné. Kevin Patrick, detektiv vědeckého obrazu známý jako Cheshire na sociálních médiích, prokázal, jak snadné to může být, a zveřejnil jeho zjištění na X. Pomocí generativní výplně nástroje AI Photoshopu, Patrick vytvořil realistické obrazy - které se mohly objevit ve vědeckých papírech - nádorů, buněčných kulturách, západních blotech a dalších. Vytvoření většina obrázků trvala méně než minutu (viz „Generování falešné vědy“).

"Pokud to dokážu, pak to určitě udělají i ti, kteří jsou placeni za vytvoření falešných údajů," říká Patrick. "Pravděpodobně existuje spousta dalších dat, která by mohla být generována pomocí nástrojů, jako je tato."

Někteří vydavatelé uvádějí nalezení důkazů o obsahu generovaném AI v publikovaných studiích. To zahrnuje PLOS, který byl upozorněn na podezřelý obsah a našel důkaz o textu a datech generovaných AI v článcích a podáních prostřednictvím interního vyšetřování, říká Renée Hoch, redaktorka etického týmu Publication Etics v San Franciscu v Kalifornii. (Hoch poznamenává, že použití AI není v časopisech PLOS zakázáno a že politika AI je založena na odpovědnosti autorovi a transparentním zveřejněním.)

Jiné nástroje by také mohly poskytnout příležitosti lidem, kteří chtějí vytvořit falešný obsah. Minulý měsíc vědci zveřejnili a 1 Generativní model AI pro vytváření obrázků mikroskopu s vysokým rozlišením-a někteří specialisté na integritu vyjádřili obavy ohledně této práce. "Tuto technologii mohou lidé snadno použít lidé se špatnými úmysly k rychlému vytvoření stovek nebo tisíců falešných obrázků," říká Bik.

Yoav Shechtman z technologického institutu Technion-Izrael v Haifě, tvůrce nástroje, říká, že tento nástroj je užitečný pro vytváření dat pro školení pro modely, protože obrázky s vysokým rozlišením je obtížné získat. Dodává však, že to není užitečné pro generování padělků, protože uživatelé mají malou kontrolu nad výsledky. Existující software pro úpravu obrázků, jako je Photoshop, je užitečnější pro manipulaci s čísly, navrhuje.

Přestože lidské oči nemusí být schopné Rozpoznat obrázky generované AI, AI by to mohlo udělat (viz „Obrázky AI je obtížné rozpoznat“).

Vývojáři nástrojů, jako jsou imagetwin a důkaz, kteří používají AI k detekci problémů s integritou ve vědeckých obrazech, rozšiřují svůj software tak, aby filtrovali obrázky vytvořené generativní AI. Protože takové obrázky jsou tak obtížné rozpoznat, obě společnosti vytvářejí své vlastní databáze generativních obrázků AI, aby trénovaly své algoritmy.

Společnost PROFEGIG již ve svém nástroji vydala funkci pro rozpoznávání obrázků mikroskopů generovaných AI. Spoluzakladatel Dror Kolodkin-Gal v Rehovotu v Izraeli říká, že při testování s tisíci AI generovanými a skutečnými obrázky z článků správně identifikoval obrazy AI 98% času a měl falešně pozitivní míru 0,02%. Dror dodává, že tým se nyní snaží pochopit, co přesně jejich algoritmus detekuje.

"Mám velké naděje na tyto nástroje," říká Christopher. Poznamenává však, že jejich výsledky musí být vždy hodnoceny odborníky, kteří mohou ověřit problémy, které naznačují. Christopher dosud neviděl žádné důkazy o tom, že software pro rozpoznávání obrázků AI je spolehlivý (Interní hodnocení důkazní dosud nebylo zveřejněno). Tyto nástroje jsou „omezené, ale určitě velmi užitečné, když nám umožňují rozšiřování našeho úsilí o kontrolu předkládání,“ dodává.

Mnoho vydavatelů a výzkumných institucí jej již používá Důkaz a Imagetwin. Například vědecké časopisy využívají prověřování pro kontrolu problémů s integritou v obrázcích. Podle Meagana Phelana, ředitele komunikace pro vědu ve Washingtonu DC, tento nástroj dosud neobjevil žádné obrázky generované AI.

Springer Nature, vydavatel Nature, vyvíjí své vlastní nástroje pro detekci textu a obrázků, nazývané Geppetto a Snapshot, které označují nepravidelnosti, které jsou pak hodnoceny lidmi. (Tým Nature News je redakčně nezávislý na svém vydavateli.)

Publikující skupiny také podnikají kroky k reagování na obrázky generované AI. Mluvčí Mezinárodní asociace vědeckých, technických a lékařských (STM) vydavatelů v Oxfordu ve Velké Británii uvedl, že tento problém bere „velmi vážně“ a reagoval na iniciativy, jako je například iniciativy United2act a centrum integrity STM, které se zabývá aktuálními problémy s povinným publikováním a dalšími problémy s akademickou integritou.

Christopher, který vede pracovní skupinu STM o změnách a duplikacích obrazu, říká, že roste povědomí o tom, že bude nutné vyvinout způsoby, jak ověřit surová data - například označováním obrázků pořízených s mikroskopy s neviditelnými vodoznaky podobnými těm, které jsou použity za použití. Vodoznaky v textech generovaných AI - To by mohla být správná cesta. To vyžaduje nové technologie a nové standardy pro výrobce zařízení, dodává.

Patrick a další se obávají, že vydavatelé nejedná dostatečně rychle, aby řešili hrozbu. "Obáváme se, že to bude jen další generace problémů v literatuře, které se nezabývají, dokud nebude příliš pozdě," říká.

Přesto jsou některé optimistické, že obsah generovaný AI se dnes objeví v článcích v budoucnu.

"Mám důvěru, že se tato technologie zlepší do té míry, že rozpozná data, která se dnes vytvářejí - protože v určitém okamžiku to bude považováno za relativně hrubé," říká Patrick. "Podvodníci by neměli v noci dobře spát. Mohli by oklamat současný proces, ale nemyslím si, že mohou tento proces oklamat navždy."

-

Saguy, A. a kol. Malý meth. https://doi.org/10.1002/smtd.202400672 (2024).

Suche

Suche

Mein Konto

Mein Konto