Raziskovalci uporabljajo tehnike iz astronomije za ustvarjanje računalniško ustvarjenega Slike "Deepfake" Prepoznati - kar lahko na prvi pogled izgleda enako resničnim fotografijam.

Z analizo slik obrazov, ki se običajno uporabljajo za preučevanje oddaljenih galaksij, lahko astronomi merijo, kako človekove oči odražajo svetlobo, kar lahko označuje znake manipulacije s sliko.

"To ni panaceja, saj imamo lažne pozitivne in lažne negativne učinke," pravi Kevin Pimbblet, direktor Centra za znanost o podatkih, umetno inteligenco in modeliranje na Univerzi Hull v Veliki Britaniji. Raziskavo je predstavil 15. julija na Nacionalnem sestanku Astronomical Society na nacionalnem srečanju. "Toda ta raziskava ponuja potencialno metodo, pomemben korak naprej, da potencialno doda teste, ki jih lahko uporabimo za ugotovitev, ali je slika resnična ali ponarejena."

Izražene fotografije

Napredek umetne inteligence (AI) vse težje otežuje razliko med resničnimi slikami, videoposnetki in zvokom tiste, ki jih ustvarijo algoritmi, prepoznati. Deepfakes nadomeščajo lastnosti ene osebe ali okolja z drugimi in se lahko zdi, kot da so posamezniki povedali ali počeli stvari, ki jih niso. Organi opozarjajo, da ta tehnologija militarizira in prispeva k širjenju napačnih informacij, na primer med volitvami, lahko se uporablja.

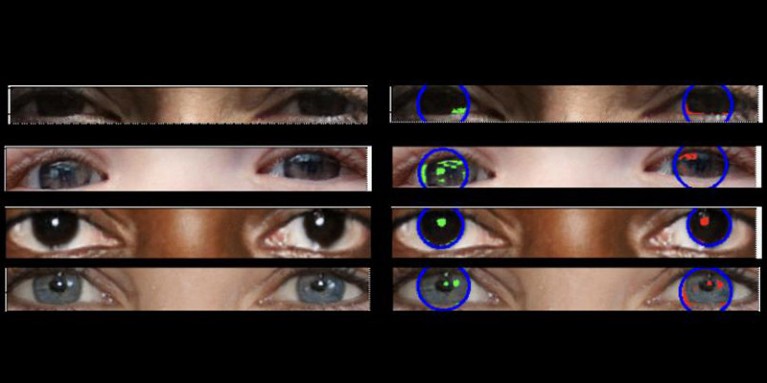

Prave fotografije bi morale imeti "dosledno fiziko", pojasnjuje Pimbblet, "zato bi morali biti odsevi, ki jih vidite v levem očesnem očesu, zelo podobni, čeprav ne nujno enaki, z odsevi v desnem očesnem očesu." Razlike so subtilne, zato so se raziskovalci obrnili na tehnike, razvite za analizo svetlobe v astronomskih slikah.

Delo, ki še ni bilo objavljeno, je bilo osnova za magistrsko nalogo Adejumoke Owolabi. Owolabi, podatkovni znanstvenik na univerzi v Hull v Veliki Britaniji, je prisilil resnične slike iz Flickr Faces HQ nabor podatkov in ustvarili ponarejene obraze s pomočjo generatorja slik. Owolabi je nato analiziral odseve iz svetlobnih virov v očeh na slikah z uporabo dveh astronomskih meritev: sistem CAS in indeks Gini. Sistem CAS količinsko opredeljuje koncentracijo, asimetrijo in gladkost porazdelitve svetlobe predmeta. Ta tehnika je astronomom, vključno s Pimbbletom, omogočila, da desetletja opisujejo luč ekstragalaktičnih zvezd. Indeks Gini meri neenakost porazdelitve svetlobe v slikah galaksij.

Owolabi je s primerjavo odsevov v očetovih očeh lahko pravilno napovedal, ali je slika ponarejena približno 70% časa. Navsezadnje so raziskovalci ugotovili, da je indeks Gini boljši od sistema CAS pri napovedovanju, ali je bila slika manipulirana.

Brant Robertson, astrofizik na kalifornijski univerzi v Santa Cruzu, pozdravlja raziskavo. "Če pa lahko izračunate vrednost, ki količinsko opredeljuje, kako realistična je lahko slika Deepfake, lahko tudi usposobite model AI, da ustvarite še boljše globoke površine z optimizacijo te vrednosti," opozarja.

Zhiwu Huang, raziskovalec AI z univerze v Southamptonu v Veliki Britaniji, pravi, da njegova lastna raziskava v očeh Deepfake slik ni opredelila nobenih nedoslednih svetlobnih vzorcev. "Čeprav posebna tehnika uporabe neskladnih odsevov v očeh zrkla morda ni široko uporabna, bi bile takšne tehnike lahko koristne za analizo subtilnih anomalij pri razsvetljavi, sencah in odsevih v različnih delih slike," pravi. "Zaznavanje neskladnosti v fizikalnih lastnostih svetlobe bi lahko dopolnilo obstoječe metode in izboljšalo splošno natančnost odkrivanja Deepfake."

Suche

Suche

Mein Konto

Mein Konto