Cercetătorii folosesc tehnici de la astronomie pentru a crea generat de computer Imagini „Deepfake” a recunoaște - care la prima vedere poate arăta identic cu fotografiile reale.

Analizând imaginile fețelor utilizate de obicei pentru a studia galaxiile îndepărtate, astronomii pot măsura modul în care ochii unei persoane reflectă lumina, ceea ce poate indica semne de manipulare a imaginii.

„Nu este un panaceu, deoarece avem false pozitive și false negative”, spune Kevin Pimbblet, directorul Centrului pentru Știința Datelor, Inteligență Artificială și Modelare la Universitatea din Hull, Marea Britanie. El a prezentat cercetarea la reuniunea națională de astronomie a Societății Royal Astronomical, pe 15 iulie. "Dar această cercetare oferă o metodă potențială, un pas important înainte, pentru a adăuga potențial testelor care pot fi utilizate pentru a afla dacă o imagine este reală sau falsă."

Fotografii exprimate

Progresele în inteligența artificială (AI) fac din ce în ce mai dificil să se spună diferența dintre imagini reale, videoclipuri și audio cei create de algoritmi, a recunoaște. DeepFakes înlocuiesc caracteristicile unei persoane sau a mediului cu ceilalți și poate face să pară ca și cum indivizii au spus sau au făcut lucruri pe care nu le -au făcut. Autoritățile avertizează că această tehnologie militarizează și contribuie la răspândirea dezinformării, de exemplu în timpul alegerilor, poate fi utilizat.

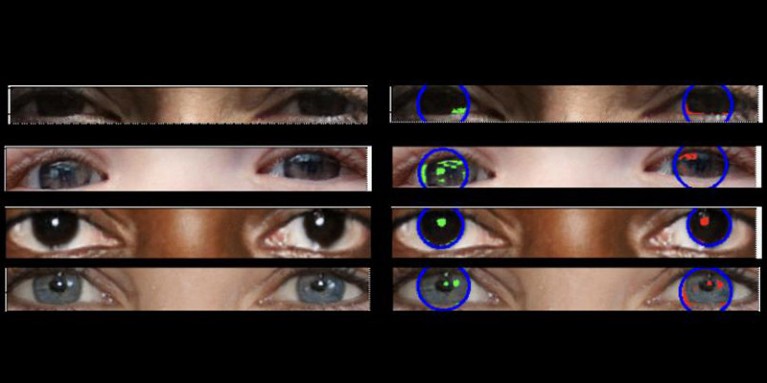

Fotografiile reale ar trebui să aibă „fizică consistentă”, explică Pimbblet, „astfel încât reflecțiile pe care le vedeți în globul ocular stâng ar trebui să fie foarte similare, deși nu neapărat identice, cu reflecțiile din globul ocular drept”. Diferențele sunt subtile, astfel încât cercetătorii au apelat la tehnici dezvoltate pentru analiza luminii în imaginile astronomice.

Lucrarea, care încă nu a fost publicată, a constituit baza pentru teza de master a lui Adejumoke Owolabi. Owolabi, un om de știință de date la Universitatea din Hull, Marea Britanie, a provenit de imagini reale de la Flickr se confruntă cu setul de date HQ și a creat fețe false folosind un generator de imagini. Owolabi a analizat apoi reflecțiile din surse de lumină din ochi în imagini folosind două măsurători astronomice: sistemul CAS și indicele Gini. Sistemul CAS cuantifică concentrația, asimetria și netezimea distribuției luminii unui obiect. Această tehnică a permis astronomilor, inclusiv Pimbblet, să caracterizeze lumina stelelor extragalactice de zeci de ani. Indicele Gini măsoară inegalitatea distribuției luminii în imaginile galaxiilor.

Comparând reflecțiile din globurile oculare ale unei persoane, Owolabi a fost capabil să prezică corect dacă imaginea era falsă cu aproximativ 70% din timp. În cele din urmă, cercetătorii au descoperit că indicele Gini a fost mai bun decât sistemul CAS pentru a prezice dacă o imagine a fost manipulată.

Brant Robertson, astrofizician la Universitatea din California, Santa Cruz, salută cercetarea. „Cu toate acestea, dacă puteți calcula o valoare care cuantifică cât de realistă poate apărea o imagine profundă, puteți, de asemenea, să antrenați modelul AI pentru a produce și mai bine Deepfakes prin optimizarea acestei valori”, avertizează el.

Zhiwu Huang, cercetător AI la Universitatea din Southampton, Marea Britanie, spune că propriile sale cercetări nu au identificat niciun tipar de lumină inconsistent în ochii imaginilor Deepfake. Dar, în timp ce tehnica specifică de utilizare a reflecțiilor inconsistente în globurile oculare poate să nu fie pe scară largă aplicabilă, astfel de tehnici ar putea fi utile pentru analiza anomaliilor subtile în iluminat, umbre și reflecții în diferite părți ale unei imagini ”, spune el. „Detectarea neconcordanțelor în proprietățile fizice ale luminii ar putea completa metodele existente și îmbunătăți precizia generală a detectării profunde.”

Suche

Suche

Mein Konto

Mein Konto