Forskere bruker teknikker fra astronomi for å lage datamaskingenererte “Deepfake” -bilder Å gjenkjenne - som ved første øyekast kan se identisk ut med ekte bilder.

Ved å analysere bilder av ansikter som vanligvis brukes til å studere fjerne galakser, kan astronomer måle hvordan en persons øyne gjenspeiler lys, noe som kan indikere tegn på bildemanipulering.

"Det er ikke et universalmiddel da vi har falske positiver og falske negativer," sier Kevin Pimbblet, direktør for Center for Data Science, Artificial Intelligence and Modelling ved University of Hull, Storbritannia. Han presenterte forskningen på Royal Astronomical Society's National Astronomy Meeting 15. juli. "Men denne forskningen gir en potensiell metode, et viktig skritt fremover, for potensielt å legge til testene som kan brukes til å finne ut om et bilde er ekte eller falske."

Uttrykte bilder

Fremskritt innen kunstig intelligens (AI) gjør det stadig vanskeligere å se forskjellen mellom virkelige bilder, videoer og lyd de som er opprettet av algoritmer, å gjenkjenne. Deepfakes erstatter funksjoner ved en person eller miljø med andre og kan få det til å se ut som om enkeltpersoner har sagt eller gjort ting som de ikke gjorde. Myndighetene advarer om at denne teknologien militariserer og bidrar til spredning av feilinformasjon, For eksempel under valg, kan brukes.

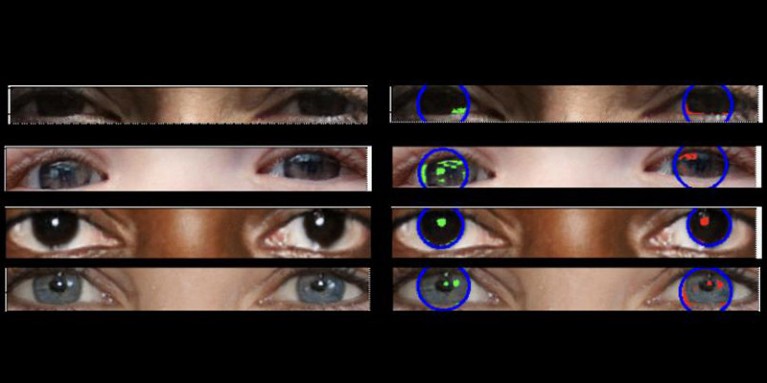

Ekte bilder skal ha "konsistent fysikk," forklarer Pimbblet, "så refleksjonene du ser i venstre øyeeplet skal være veldig like, selv om de ikke nødvendigvis er identiske, med refleksjonene i høyre øyeeplet." Forskjellene er subtile, så forskerne henvendte seg til teknikker utviklet for å analysere lys i astronomiske bilder.

Arbeidet, som ennå ikke er publisert, dannet grunnlaget for Adejumoke Owolabis mesteroppgave. Owolabi, en dataforsker ved University of Hull, Storbritannia, hentet ekte bilder fra Flickr står overfor HQ -datasett og skapte falske ansikter ved hjelp av en bildegenerator. Owolabi analyserte deretter refleksjonene fra lyskilder i øynene på bildene ved bruk av to astronomiske målinger: CAS -systemet og Gini -indeksen. CAS -systemet kvantifiserer konsentrasjonen, asymmetri og glatthet i et objekts lysfordeling. Denne teknikken har gjort det mulig for astronomer, inkludert Pimbblet, å karakterisere lyset fra ekstragalaktiske stjerner i flere tiår. Gini -indeksen måler ulikheten i lysfordeling i bilder av galakser.

Ved å sammenligne refleksjonene i en persons øyeboller, var Owolabi i stand til å forutsi riktig om bildet var falske omtrent 70% av tiden. Til syvende og sist fant forskerne at Gini -indeksen var bedre enn CAS -systemet ved å forutsi om et bilde hadde blitt manipulert.

Brant Robertson, en astrofysiker ved University of California, Santa Cruz, ønsker forskningen velkommen. "Imidlertid, hvis du kan beregne en verdi som kvantifiserer hvor realistisk et dypfakebilde kan vises, kan du også trene AI -modellen til å produsere enda bedre dypfakes ved å optimalisere den verdien," advarer han.

Zhiwu Huang, en AI -forsker ved University of Southampton, Storbritannia, sier at hans egen forskning ikke har identifisert noen inkonsekvente lysmønstre i øynene til Deepfake -bilder. Men "selv om den spesifikke teknikken for å bruke inkonsekvente refleksjoner i øyebollene kanskje ikke er mye anvendelige, kan slike teknikker være nyttige for å analysere subtile anomalier i belysning, skygger og refleksjoner i forskjellige deler av et bilde," sier han. "Å oppdage uoverensstemmelser i de fysiske egenskapene til lys kan utfylle eksisterende metoder og forbedre den generelle nøyaktigheten av dypfakedeteksjon."

Suche

Suche

Mein Konto

Mein Konto