A kutatók a csillagászat technikáit használják számítógéppel generáltak létrehozásához „Deepfake” képek felismerni - ami első pillantásra megegyezik a valódi fotókkal.

A távoli galaxisok tanulmányozására jellemző arcok képeinek elemzésével a csillagászok megmérhetik, hogy az ember szeme hogyan tükrözi a fényt, ami jelezheti a kép manipulációjának jeleit.

"Ez nem csodaszer, mivel hamis pozitív és hamis negatívok vannak" - mondta Kevin Pimblet, az Egyesült Királyság Hull Egyetemen a Data Science, Mesterséges Intelligencia és Modellezés igazgatója. A kutatást a Királyi Csillagászati Társaság Nemzeti Csillagászat ülésén, július 15 -én mutatta be. "De ez a kutatás potenciális módszert, fontos előrelépést kínál, hogy potenciálisan hozzáadja azokat a teszteket, amelyek felhasználhatók annak kiderítésére, hogy egy kép valódi vagy hamis."

Kifejezett fotók

A mesterséges intelligencia (AI) fejlődése egyre nehezebbé teszi a különbséget a valós képek, videók és audio között Az algoritmusok által létrehozott, felismerni. A Deepfakes helyettesíti az egyik személy vagy a környezet tulajdonságait másokkal, és úgy tűnhet, mintha az egyének mondanák vagy megtettek olyan dolgokat, amelyeket nem tettek. A hatóságok figyelmeztetik, hogy ez a technológia militarizálja és hozzájárul a téves információk terjedéséhez, például a választások során, használható.

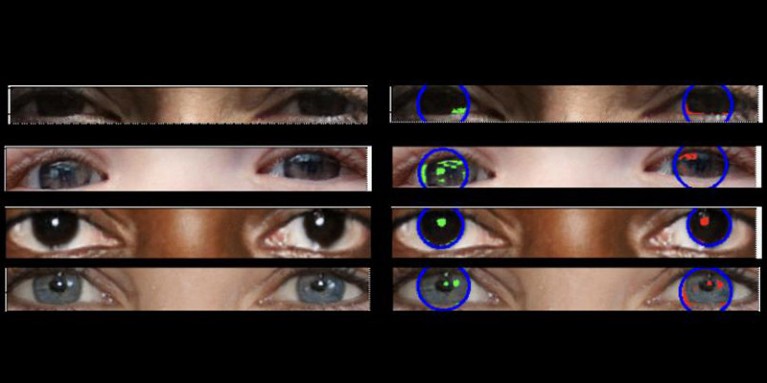

A valódi fotóknak "következetes fizikának kell lennie" - magyarázza PimbLlet -, tehát a bal szemgolyóban látott gondolatoknak nagyon hasonlónak kell lenniük, bár nem feltétlenül azonosnak kell lenniük a jobb szemgolyó tükröződéseivel. " A különbségek finomak, tehát a kutatók a csillagászati képeken a fény elemzésére kifejlesztett technikákhoz fordultak.

A még nem közzétett munka képezte az Adejumoke Owolabi diplomamunkájának alapját. Owolabi, az Egyesült Királyság Hull Egyetem adattudósának valódi képei a Flickr Faces HQ adatkészlet és hamis arcokat hozott létre egy képgenerátor segítségével. Az Owolabi ezután két csillagászati méréssel elemezte a képek fényforrásainak tükröződéseit: a CAS rendszer és a GINI -index. A CAS rendszer számszerűsíti az objektum fényeloszlásának koncentrációját, aszimmetriáját és simaságát. Ez a technika lehetővé tette, hogy a csillagászok, köztük a Pimbblet, évtizedek óta jellemezzék az extragalaktikus csillagok fényét. A GINI -index méri a fényeloszlás egyenlőtlenségét a galaxisok képein.

Az ember szemgolyóinak reflexióinak összehasonlításával Owolabi képes volt helyesen megjósolni, hogy a kép az idő kb. 70% -át hamis -e. Végül a kutatók azt találták, hogy a Gini -index jobb, mint a CAS rendszer, amikor megjósolják, hogy egy képet manipuláltak -e.

Brant Robertson, a Santa Cruzi Kaliforniai Egyetem asztrofizikus üdvözli a kutatást. "Ha azonban kiszámíthat egy olyan értéket, amely számszerűsíti a mélyfajta kép reális megjelenését, akkor az AI modellt is kiképezheti, hogy még jobb mélyfestéket hozzon létre az érték optimalizálásával" - figyelmezteti.

Zhiwu Huang, az Egyesült Királyság Southamptoni Egyetem AI kutatója szerint a saját kutatása nem azonosított semmiféle következetlen fénymintát a Deepfake képek szemében. De "bár a szemgolyókban az inkonzisztens reflexiók felhasználásának specifikus technikája nem feltétlenül alkalmazható, az ilyen technikák hasznosak lehetnek a finom rendellenességek elemzéséhez, az árnyékban és a tükrökben a kép különböző részein" - mondja. "A fény fizikai tulajdonságaiban szereplő következetlenségek kimutatása kiegészítheti a meglévő módszereket és javíthatja a mélyfajta észlelésének általános pontosságát."

Suche

Suche

Mein Konto

Mein Konto