Istraživači koriste tehnike iz astronomije za stvaranje računalno generiranih Slike "DeepFake" prepoznati - što na prvi pogled može izgledati identično stvarnim fotografijama.

Analizirajući slike lica koja se obično koriste za proučavanje udaljenih galaksija, astronomi mogu izmjeriti kako oči osobe odražavaju svjetlost, što može ukazivati na znakove manipulacije slika.

"To nije panaceja jer imamo lažne pozitivne i lažne negativnosti", kaže Kevin Pimbblet, direktor Centra za znanost o podacima, umjetnu inteligenciju i modeliranje na Sveučilištu u Hulu u Velikoj Britaniji. Istraživanje je predstavio na nacionalnom sastanku astronomije Kraljevskog astronomskog društva 15. srpnja. "Ali ovo istraživanje nudi potencijalnu metodu, važan korak naprijed, kako bi se potencijalno dodalo testovima koji se mogu upotrijebiti za otkrivanje je li slika stvarna ili lažna."

Izražene fotografije

Napredak u umjetnoj inteligenciji (AI) otežava sve teže reći razliku između stvarnih slika, videozapisa i zvuka Oni stvoreni algoritmima, prepoznati. DeepFakes zamjenjuju značajke jedne osobe ili okoliša s drugima i mogu učiniti da se čini kao da su pojedinci rekli ili radili stvari koje nisu. Vlasti upozoravaju da je ova tehnologija militariziraju i doprinosi širenju dezinformacija, Na primjer tijekom izbora, može se koristiti.

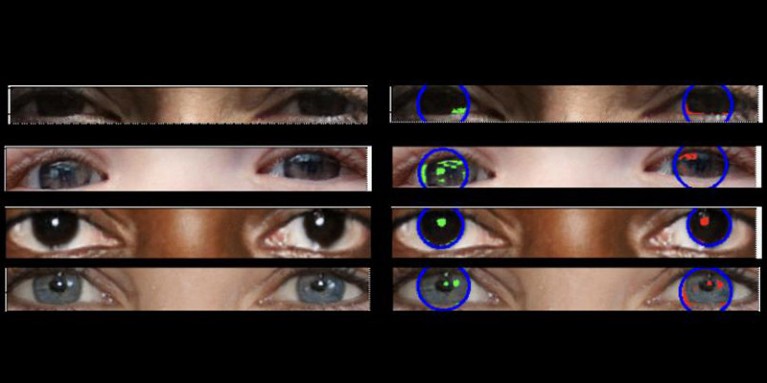

Prave fotografije trebale bi imati "dosljednu fiziku", objašnjava Pimbblet, "pa bi odraz koje vidite u lijevoj očnoj jabučici trebaju biti vrlo slični, iako ne nužno i identični, refleksijama u desnoj očnoj jabučici." Razlike su suptilne, pa su se istraživači okrenuli tehnikama razvijenim za analizu svjetla u astronomskim slikama.

Djelo, koje još nije objavljeno, činilo je osnovu za magistarski rad Adejumoke Owolabija. Owolabi, znanstvenik podataka sa Sveučilišta u Hulu u Velikoj Britaniji, dobivao je stvarne slike iz Flickr se suočava s skupom podataka HQ i stvorio lažna lica pomoću generatora slike. Owolabi je zatim analizirao odraz iz izvora svjetlosti u očima na slikama koristeći dva astronomska mjerenja: CAS sustav i Gini indeks. CAS sustav kvantificira koncentraciju, asimetriju i glatkoću raspodjele svjetlosti objekta. Ova tehnika omogućila je astronomima, uključujući Pimbblet, da desetljećima karakteriziraju svjetlost ekstragalaktičkih zvijezda. Gini indeks mjeri nejednakost raspodjele svjetlosti u slikama galaksija.

Uspoređujući refleksije u očne jabučice osobe, Owolabi je uspio ispravno predvidjeti je li slika lažna oko 70% vremena. U konačnici, istraživači su otkrili da je Gini indeks bolji od CAS sustava predviđajući je li slika manipulirana.

Brant Robertson, astrofizičar sa Sveučilišta u Kaliforniji, Santa Cruz, pozdravlja istraživanje. "Međutim, ako možete izračunati vrijednost koja kvantificira kako se može pojaviti realistična slika DeepFake -a, možete obučiti i AI model kako bi proizveli još bolje duboke faze optimiziranjem te vrijednosti", upozorava on.

Zhiwu Huang, istraživač AI sa Sveučilišta u Southamptonu u Velikoj Britaniji, kaže da njegovo vlastito istraživanje nije identificiralo nikakve nedosljedne obrasce svjetlosti u očima DeepFake slika. No "Iako specifična tehnika korištenja nedosljednih refleksija u očne jabučice možda nije široko primjenjiva, takve bi tehnike mogle biti korisne za analizu suptilnih anomalija u osvjetljenju, sjenama i refleksijama u različitim dijelovima slike", kaže on. "Otkrivanje nedosljednosti u fizičkim svojstvima svjetlosti moglo bi nadopuniti postojeće metode i poboljšati ukupnu točnost detekcije DeepFakea."

Suche

Suche

Mein Konto

Mein Konto