Изследователите използват техники от астрономия, за да създадат компютърно генерирани „Deepfake“ изображения Да разпознае - което на пръв поглед може да изглежда идентично с истинските снимки.

Чрез анализиране на изображения на лица, обикновено използвани за изучаване на далечни галактики, астрономите могат да измерват как очите на човек отразяват светлината, което може да показва признаци на манипулация на изображението.

„Това не е панацея, тъй като имаме фалшиви позитиви и фалшиви негативи“, казва Кевин Пимббъл, директор на Центъра за наука за данни, изкуствен интелект и моделиране в Университета в Хъл, Великобритания. Той представи изследванията на Националната среща на Астрономическото дружество на Кралското астрономическо дружество на 15 юли. „Но това изследване предлага потенциален метод, важна стъпка напред, за да добави потенциално към тестовете, които могат да бъдат използвани, за да се разбере дали изображението е истинско или фалшиво“.

Изразени снимки

Напредъкът в изкуствения интелект (AI) прави все по -трудно да се каже разликата между реални изображения, видеоклипове и аудио тези, създадени от алгоритми, да разпознае. Deepfakes заменя характеристиките на един човек или среда с други и може да изглежда, че хората са казали или са правили неща, които не са го направили. Властите предупреждават, че тази технология е милитаризираща и допринася за разпространението на дезинформация, Например по време на изборите, може да се използва.

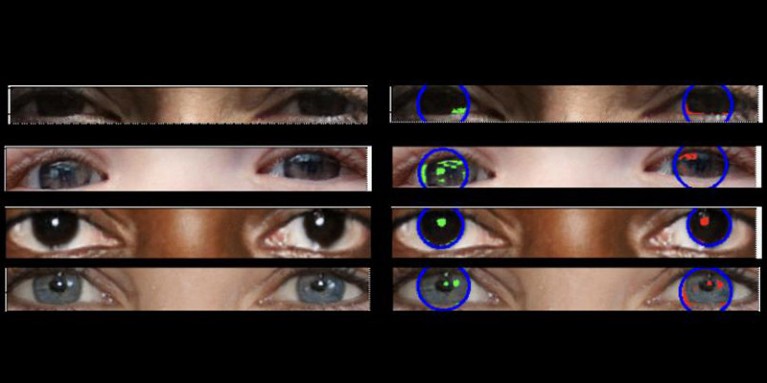

Истинските снимки трябва да имат „последователна физика“, обяснява Pimbblet, „така че отраженията, които виждате в лявата очна ябълка, трябва да са много подобни, макар и не непременно идентични, с отраженията в дясната очна ябълка“. Разликите са фини, така че изследователите се обърнаха към техники, разработени за анализ на светлина в астрономически образи.

Работата, която все още не е публикувана, е основата за магистърската теза на Адеджумоке Оволаби. Оволаби, учен по данни от Университета в Хъл, Великобритания, получени истински изображения от Flickr се изправя пред HQ набор от данни и създаде фалшиви лица с помощта на генератор на изображения. След това Owolabi анализира отраженията от източници на светлина в очите в изображенията, използвайки две астрономически измервания: системата CAS и индекса Gini. Системата CAS количествено определя концентрацията, асиметрията и гладкостта на разпределението на светлината на обекта. Тази техника позволи на астрономите, включително Pimbblet, да характеризират светлината на екстрагалактичните звезди от десетилетия. Индексът на Джини измерва неравенството на разпределението на светлината в изображенията на галактиките.

Сравнявайки отраженията в очните ябълки на човек, Оволаби успя правилно да предскаже дали изображението е фалшиво около 70% от времето. В крайна сметка изследователите откриха, че индексът на Джини е по -добър от системата на CAS при прогнозиране дали изображение е манипулирано.

Брант Робъртсън, астрофизик от Калифорнийския университет, Санта Крус, приветства изследването. „Въпреки това, ако можете да изчислите стойност, която количествено определя колко реалистично може да се появи изображение на Deepfake, можете също да обучите AI модела да произвежда още по -добри Deepfakes, като оптимизирате тази стойност“, предупреждава той.

Zhiwu Huang, изследовател на ИИ от Университета в Саутхемптън, Великобритания, казва, че собствените му изследвания не са идентифицирали никакви непоследователни светлинни модели в очите на изображенията на Deepfake. Но „макар специфичната техника за използване на непоследователни отражения в очните ябълки може да не е широко приложима, такива техники могат да бъдат полезни за анализ на фини аномалии при осветление, сенки и отражения в различни части на изображението“, казва той. „Откриването на несъответствия във физическите свойства на светлината може да допълни съществуващите методи и да подобри общата точност на откриването на Deepfake.“

Suche

Suche

Mein Konto

Mein Konto